Extensions d’agents IA pour coder ou agents IA en ligne de commande, que choisir en 2025 ?

En 2025, l’intelligence artificielle s’impose comme un outil incontournable pour les développeurs. Les agents IA pour coder ne sont plus de simples gadgets : ils transforment concrètement la manière dont on écrit, teste et déploie du code. Mais une question cruciale se pose pour ceux qui veulent tirer parti de cette révolution : faut-il privilégier les extensions d’agents IA intégrées dans les éditeurs de code comme VS Code, ou bien opter pour des agents IA en ligne de commande (terminal-based), plus proches du système et souvent plus flexibles ? Peut-on utiliser ces deux solutions en même temps ?

Avec la puissance des nouvelles cartes graphiques comme la RTX 5090 et l’arrivée de modèles open source spécialisés dans le code tels que DeepSeek-Coder, Qwen3-30B, Llama 3 70B, ou encore GPT-OSS:20B, il est désormais possible d’exécuter ces agents localement. Cela offre des avantages majeurs : confidentialité, rapidité et indépendance vis-à-vis du cloud.

Dans cet article, nous allons explorer en profondeur les différences entre extensions IA pour coder et agents IA en terminal, comparer leurs usages, avantages et limites, puis identifier lequel correspond le mieux à vos besoins en 2025.

Qu’est-ce qu’une extension d’agent IA pour coder ?

Les extensions d’agents IA pour coder sont des outils directement intégrés dans les éditeurs de code comme Visual Studio Code ou JetBrains. Leur objectif est simple : assister le développeur en temps réel, sans quitter son environnement de travail. Elles fonctionnent comme un assistant vituel, capable de proposer des solutions, d’expliquer du code ou encore de générer des tests unitaires.

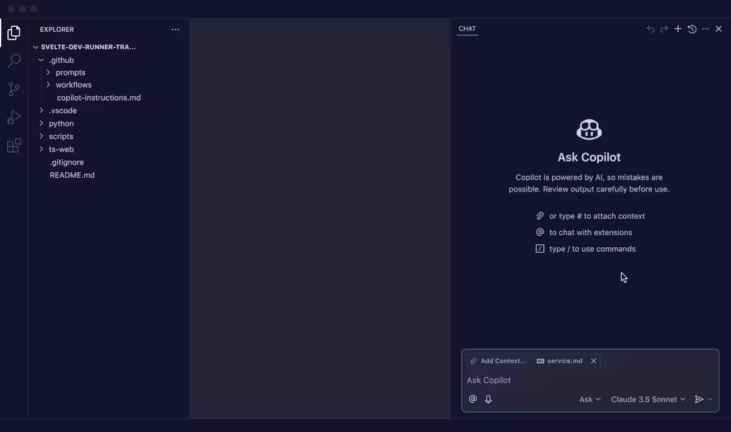

Parmi les plus connues, on retrouve GitHub Copilot (version gratuite limitée, 10$/mois ou 39$) ou encore Tabnine. GitHub Copilot s’appuie sur une intégration native dans VS Code pour fournir de l’autocomplétion intelligente et même gérer des workflows plus complexes comme l’ouverture de pull requests. Comme le souligne le blog de Visual Studio Code, l’expérience est fluide et pensée pour améliorer directement la productivité quotidienne du développeur.

D’autres extensions comme ChatGPT – CodeGPT ajoutent une interface de chat permettant de poser des questions directement dans l’éditeur.

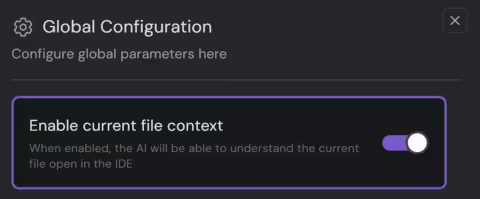

L’avantage principal des extensions IA dans les IDE est leur simplicité d’utilisation : il suffit d’installer un plugin pour accéder à la puissance d’un LLM pour vous assister. La majorité des extensions IA propose un abonnement avec un usage Cloud soumis à quota. Toutefois, certaines extensions peuvent se connecter à un modèle open source hébergé en local ou sur un de vos serveurs. Des modèles open source comme DeepSeek-Coder, Qwen3 ou Code Llama 3, peuvent être exécutés localement via des outils comme Ollama ou LM Studio.

Qu’est-ce qu’un agent IA en ligne de commande ?

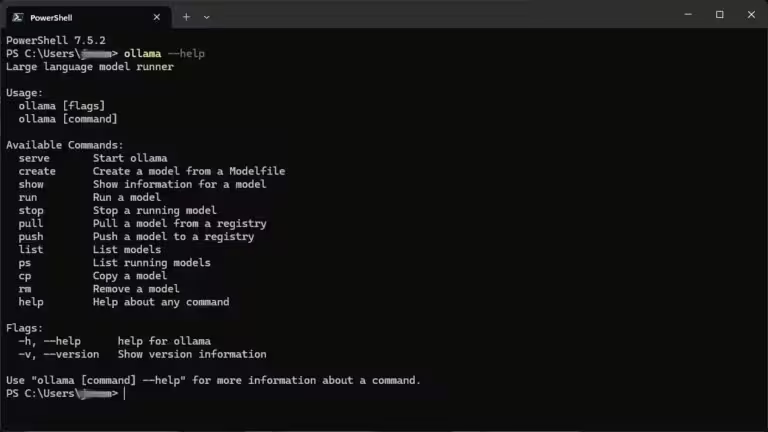

Les agents IA en ligne de commande, aussi appelés agents IA en terminal (terminal-based AI coding agents), fonctionnent directement dans le shell (Bash, Zsh, PowerShell). Contrairement aux extensions intégrées à un IDE, ces outils s’exécutent dans un environnement minimaliste et offrent un contrôle plus poussé sur le système, les fichiers et les workflows.

Leur rôle ne se limite pas à l’autocomplétion. Un agent IA terminal peut par exemple générer du code dans plusieurs fichiers, lancer des tests unitaires, exécuter des scripts, gérer des commits Git, ou encore corriger automatiquement des erreurs détectées dans les logs. En pratique, ils agissent comme un développeur virtuel en ligne de commande, capable d’automatiser des séquences complexes.

Parmi les outils les plus populaires en 2025, on retrouve aider (Cloud et local), connu pour son intégration fluide avec Git, Claude Code (payant), Cline et Gemini CLI (Open Source avec de nombreux fork), qui permettent d’interagir avec de puissants modèles d’IA. Il y a également des projets open source comme OpenDevin et Smol Developer, qui expérimentent une autonomie accrue dans l’exécution de tâches multi-étapes.

Comme le rappelle Shakudo.io, ces agents IA pour coder en terminal séduisent particulièrement les développeurs orientés DevOps ou ceux qui travaillent sur des projets nécessitant beaucoup d’automatisation. Leur force réside dans leur flexibilité et leur proximité avec l’infrastructure, même si l’expérience utilisateur est moins visuelle qu’avec une extension IDE. Toutefois rien ne vous empêche d’utiliser un agents IA pour coder via le terminal, puis ouvrir votre projet avec Visual Studio Code (ou autre) afin de profiter d’une extension de code IA pour affiner.

Extensions IA vs agents en terminal – tableau comparatif

La question revient souvent en 2025 : faut-il privilégier une extension d’agent IA pour coder dans un IDE comme VS Code, ou un agent IA en terminal (terminal-based) ? Les deux approches poursuivent le même objectif, améliorer la productivité et automatiser les tâches, mais elles s’adressent à des profils différents.

Les extensions IA brillent par leur confort d’utilisation. En installant un simple plugin, on bénéficie d’un assistant de code intégré capable de compléter, refactoriser ou documenter le code en temps réel. Des outils comme GitHub Copilot s’insèrent parfaitement dans le flux de travail quotidien d’un développeur, avec une expérience visuelle claire et intuitive.

À l’inverse, les agents IA en ligne de commande privilégient la puissance et la flexibilité. Ils sont particulièrement appréciés pour les tâches complexes : automatisation de tests, gestion Git, génération de fichiers multiples ou exécution de pipelines. Des solutions comme aider ou Claude Code permettent même d’orchestrer des projets entiers via le terminal, ce qui séduit les développeurs DevOps ou full stack.

Voici un résumé comparatif :

| Critère | Extensions d’agents IA (IDE) | Agents IA en terminal (CLI) |

|---|---|---|

| Usage principal | Autocomplétion, refactoring, debug dans VS Code ou JetBrains. | Automatisation, gestion de projet, exécution de commandes système. |

| Exemples | GitHub Copilot, ChatGPT CodeGPT, Tabnine, Continue, Local LLM Copilot | aider, Claude Code, Gemini CLI, OpenDevin, Smol Developer. |

| Avantages | Simplicité, confort visuel, gain immédiat de productivité. | Flexibilité, contrôle, intégration Git, automatisation avancée. |

| Limites | Dépendance à l’IDE, parfois lié au cloud. | Expérience moins intuitive, nécessite une maîtrise du terminal. |

Comme le montre TechCommunity Microsoft, l’avenir repose sans doute sur une approche hybride, combinant extensions et agents terminal selon les besoins.

Quel impact sur la productivité en 2025 ?

L’adoption des agents IA pour coder, qu’il s’agisse d’extensions dans les IDE ou d’agents en terminal, transforme profondément la productivité des développeurs en 2025. L’impact est visible à plusieurs niveaux.

Pour un développeur individuel, une extension IA dans VS Code permet de gagner un temps précieux sur des tâches répétitives : autocomplétion intelligente, génération de documentation, correction de bugs simples. Comme le rappelle le blog officiel de Visual Studio Code, ces outils s’intègrent si bien dans le flux de travail que le gain de productivité devient presque invisible… jusqu’au moment où l’on réalise que certaines tâches prennent deux fois moins de temps.

Du côté des agents IA en terminal, le bénéfice se situe dans l’automatisation avancée. Un outil comme aider ou Claude Code peut gérer un cycle complet : lancer les tests, corriger les erreurs, générer un commit Git et même documenter les modifications. Cela représente un gain considérable pour les équipes DevOps, où la coordination entre développement et infrastructure est clé.

Enfin, la possibilité d’exécuter ces agents localement sur un GPU haut de gamme comme l’RTX 5090 renforce encore l’adoption. Non seulement la latence est réduite, mais la confidentialité est préservée. Il est souvent problématique de donner un accès complet à votre projet à une IA executé dans le Cloud. Comme le souligne Marktechpost, les modèles comme DeepSeek-Coder ou Qwen3-30B offrent des performances de pointe, accessibles sans dépendance au cloud.

Quand choisir une extension d’agent IA ?

Les extensions d’agents IA pour coder sont le choix idéal lorsque l’on recherche une intégration fluide et immédiate dans son environnement de développement. Elles s’adressent surtout aux développeurs qui passent la majorité de leur temps dans un IDE comme Visual Studio Code ou JetBrains, et qui veulent un assistant IA intégré pour gagner du temps au quotidien.

En pratique, une extension IA est parfaite pour :

- écrire plus vite avec une autocomplétion contextuelle ;

- refactoriser un fichier complexe sans effort ;

- générer des tests unitaires en quelques secondes ;

- obtenir une explication claire d’un bloc de code ;

- accélérer le debugging directement dans l’éditeur.

Des solutions comme GitHub Copilot offrent une expérience complète, avec la possibilité de suggérer du code multi-langage et même d’intervenir sur des projets entiers. D’autres, comme Cline, privilégient la transparence et la compatibilité avec des LLMs open source tournant localement, tels que DeepSeek-Coder ou Llama 3 70B quantized via Ollama ou LM Studio.

L’avantage principal réside dans la simplicité : quelques clics suffisent pour installer une extension et profiter d’un véritable compagnon de travail. Ces outils s’imposent comme les plus accessibles pour les développeurs souhaitant améliorer immédiatement leur productivité, sans changer leurs habitudes.

Quand choisir un agent IA en terminal ?

Les agents IA en ligne de commande s’adressent surtout aux développeurs qui privilégient la flexibilité et l’automatisation avancée. Contrairement aux extensions IA dans un IDE, ces outils fonctionnent directement dans le terminal et peuvent orchestrer des workflows complets, bien au-delà de la simple autocomplétion de code.

Un agent IA via un terminal est particulièrement utile dans les cas suivants :

- automatiser la création et la modification de fichiers dans un projet complexe ;

- lancer une suite de tests unitaires puis corriger les erreurs détectées ;

- gérer l’intégration continue avec des commits Git et pipelines CI/CD ;

- exécuter des scripts système ou des commandes spécifiques à l’infrastructure ;

- travailler dans un environnement minimaliste sans dépendance à un IDE.

Des solutions comme aider, Cline, Claude Code ou Gemini CLI sont déjà plébiscitées pour leur efficacité dans les projets DevOps et full stack. D’autres, comme OpenDevin et Smol Developer, explorent des scénarios d’autonomie encore plus poussés, capables de gérer plusieurs étapes de développement sans intervention humaine.

L’un des atouts majeurs des agents IA en terminal est leur compatibilité, partielle ou complète, avec des modèles open source exécutés localement ou sur votre serveur. En utilisant des LLMs comme Qwen3-30B, DeepSeek-Coder 33B ou gpt-oss, il devient possible d’obtenir un agent puissant, rapide et totalement indépendant du cloud. Ce type d’outil attire les développeurs expérimentés qui veulent garder un contrôle total sur leurs workflows.

Les meilleurs modèles open source et outils locaux en 2025

L’une des grandes évolutions récente est la possibilité d’exécuter des agents IA pour coder en local, grâce aux GPU haut de gamme comme l’RTX 5090 (32 Go VRAM). Cela ouvre la porte à une nouvelle génération de modèles open source optimisés pour la programmation, accessibles sans dépendre du cloud et personnalisable.

Parmi les plus performants, on retrouve :

- Qwen3-30B (quantized) : reconnu pour sa vitesse (jusqu’à 60 tokens/s sur RTX 5090) et ses excellentes capacités de raisonnement. Il est particulièrement adapté aux tâches multilingues et aux projets complexes.

- DeepSeek-Coder 33B/34B : modèles spécialisés dans le code, offrant une robustesse remarquable pour la génération et la correction de programmes.

- Llama 3 70B Instruct (quantized 4–5 bits) : modèle polyvalent, capable de gérer un large éventail de langages et apprécié pour ses performances.

- StarCoder2 (15B ou 30B) : pensé pour le développement logiciel, il brille sur le scripting et les projets multi-langages.

- GPT-OSS:20B : un excellent compromis pour ceux qui veulent un modèle léger mais puissant. En quantization MXFP4, il ne requiert que 16 Go de VRAM.

Pour déployer ces modèles, plusieurs outils facilitent la tâche :

- Ollama, qui simplifie l’utilisation via le terminal ;

- LM Studio, une interface graphique conviviale ;

- Nut Studio, qui centralise la gestion de plusieurs modèles ;

- llama.cpp, référence open source pour des performances optimisées.

Cette combinaison entre modèles quantifiés et outils de déploiement locaux permet aux développeurs d’obtenir un agent IA de codage puissant, rapide et respectueux de la confidentialité.

Recommandations pratiques selon votre profil

En 2025, le choix entre extensions d’agents IA pour coder et agents IA en terminal dépend avant tout de votre profil et de vos priorités.

- Développeur individuel ou freelance : si votre objectif est de gagner du temps dans l’écriture et la correction de code, une extension IA dans un IDE comme GitHub Copilot est la solution la plus simple. L’expérience est fluide et vous restez dans votre environnement habituel (VS Code, JetBrains).

- Équipe technique orientée DevOps ou full stack : pour les projets nécessitant beaucoup d’automatisation (tests, déploiements, pipelines), les agents IA en terminal comme aider, Claude Code ou OpenDevin sont plus adaptés. Ils permettent de centraliser et d’automatiser des workflows entiers directement via le shell.

- Passionné de hardware et de performance : si vous disposez d’une RTX 5090 ou équivalent, exploiter un LLM local quantifié (comme Qwen3-30B, DeepSeek-Coder 33B ou GPT-OSS:20B) via Ollama ou LM Studio vous offrira puissance, confidentialité et indépendance vis-à-vis du cloud.

Au final, les deux approches sont complémentaires : un développeur peut très bien utiliser une extension IA pour ses tâches quotidiennes dans l’éditeur, et un agent terminal pour automatiser ses pipelines et ses tests. Comme le rappelle TechCommunity Microsoft, l’avenir appartient sans doute aux workflows hybrides.

FAQ – Autres questions fréquentes

Quelle est la différence entre une extension IA et un agent IA en terminal ?

Une extension IA s’intègre dans un éditeur comme VS Code pour assister directement à l’écriture et au débogage du code. Un agent IA en terminal agit dans le shell pour automatiser des tâches plus larges comme les tests, la gestion Git ou les déploiements.

Est-ce que les agents IA pour coder fonctionnent hors ligne ?

Oui, à condition d’utiliser des LLMs open source locaux comme Qwen3-30B ou GPT-OSS:20B via des outils comme Ollama ou LM Studio. Cela garantit confidentialité et rapidité.

Quels sont les meilleurs modèles open source pour coder en 2025 ?

Les plus populaires sont DeepSeek-Coder, Llama 3 70B quantized, StarCoder2 et Qwen3-30B.

Faut-il une grosse configuration PC pour les utiliser ?

Une RTX 5090 (32 Go VRAM) est idéale pour les modèles 30B et 70B. Mais avec la quantization 4-bit, certains modèles comme GPT-OSS:20B tournent dès 16 Go VRAM.

GitHub Copilot est-il confidentiel ?

Copilot repose sur le cloud, donc les données peuvent transiter vers des serveurs externes. Pour une confidentialité totale, mieux vaut opter pour des agents IA locaux.

Conclusion

En 2025, les agents IA pour coder ne sont plus une curiosité mais un véritable levier de productivité pour les développeurs. Le choix entre une extension IA dans un éditeur comme VS Code et un agent IA en terminal dépend avant tout de vos besoins et de votre manière de travailler.

Si vous cherchez la simplicité et l’efficacité immédiate, les extensions IA comme GitHub Copilot ou Cline transforment votre IDE en un véritable assistant de programmation. Si au contraire vous privilégiez la flexibilité, l’automatisation et le contrôle, les agents IA en ligne de commande comme aider ou Claude Code s’imposent naturellement.

Avec la puissance des GPU modernes comme la RTX 5090 et l’arrivée de modèles open source tels que DeepSeek-Coder, Qwen3-30B ou GPT-OSS:20B, il est désormais possible d’exécuter ces agents en local, sans dépendance au cloud, alliant confidentialité et rapidité. Certes ces LLM sont moins précis que Claude qui reste la référence, mais leurs faibles coûts permettent un usage plus intensif, et en fonction de votre implémentation / usage, le résultat peut concurrencer les offres Cloud.

Au final, il n’y a pas un choix unique mais une complémentarité : l’avenir appartient sans doute aux développeurs qui sauront combiner extensions IA et agents terminal pour tirer le meilleur des deux mondes.

Pour ne rien rater, abonnez-vous à Cosmo Games sur Google News et suivez-nous sur X (ex Twitter) en particulier pour les bons plans en direct. Vos commentaires enrichissent nos articles, alors n'hésitez pas à réagir ! Un partage sur les réseaux nous aide énormément. Merci pour votre soutien !