Que faire lorsque la fenêtre contextuelle d’une IA est insuffisante ?

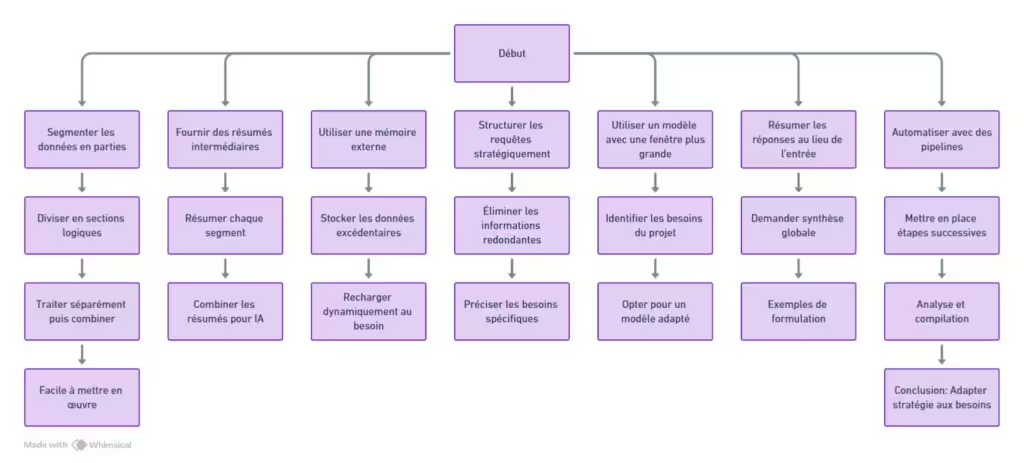

Lorsque la fenêtre contextuelle d’une IA générative, comme ChatGPT ou une autre, est insuffisante pour traiter toutes les informations en entrée, plusieurs stratégies peuvent être utilisées pour contourner cette limitation.

Voici des solutions concrètes pour gérer des projets où le contexte dépasse la capacité maximale de tokens.

A lire : Que signifie le terme fenêtre contextuelle avec les IA ?

1. Segmenter les données en plusieurs parties

La méthode la plus simple consiste à diviser les informations en blocs plus petits, chacun respectant la limite de tokens.

Comment faire ?

- Découpez le texte ou les données en sections logiques et traitez-les individuellement.

- Par exemple, si vous analysez un document de 200 000 tokens avec une IA ayant une fenêtre de 128 000 tokens, divisez-le en deux parties.

- Traitez chaque section séparément, puis résumez ou combinez les résultats.

Avantages :

- Facile à mettre en œuvre.

- Permet de conserver des réponses détaillées sur chaque partie.

2. Fournir des résumés intermédiaires

Pour les textes ou données très volumineux, il peut être judicieux de résumer les informations avant de les soumettre à l’IA.

Comment faire ?

- Divisez le contenu en segments.

- Résumez chaque segment à l’aide d’une IA ou manuellement.

- Transmettez uniquement les résumés à l’IA dans une nouvelle requête.

Exemple :

Si vous devez traiter un document long, vous pouvez demander :

« Résume ce document en 3 paragraphes. »

Ensuite, combinez les résumés pour une vue d’ensemble.

3. Utiliser une mémoire externe (logique de stockage externe)

Lorsque la fenêtre contextuelle est insuffisante, une mémoire externe ou un outil de gestion des données peut être utilisé pour stocker les informations pertinentes.

Comment faire ?

- Conservez les données excédentaires dans un fichier ou une base de données externe.

- Transmettez à l’IA uniquement les éléments nécessaires en fonction de la conversation ou de la tâche en cours.

Exemple :

Dans un dialogue interactif, rechargez dynamiquement les segments pertinents en fonction des questions posées.

4. Structurer les requêtes de manière stratégique

Une formulation claire et concise de vos requêtes permet d’optimiser l’espace utilisé par les tokens.

Comment faire ?

- Éliminez les informations redondantes ou inutiles.

- Privilégiez des formulations précises pour réduire le nombre de tokens nécessaires.

Exemple :

Au lieu de poser une question générique comme :

« Peux-tu analyser tout ce texte ? »

Précisez :

« Analyse uniquement les éléments financiers de cette section. »

5. Utiliser un modèle avec une fenêtre contextuelle plus grande

Si les solutions précédentes ne suffisent pas, envisagez d’utiliser un modèle d’IA ayant une fenêtre contextuelle plus importante, comme GPT-4o (128 000 tokens) ou des modèles spécialement optimisés pour le traitement de grands volumes.

Comment faire ?

- Identifiez les besoins exacts de votre projet.

- Optez pour un modèle qui correspond à la taille et à la complexité des données.

6. Résumer les réponses au lieu de l’entrée

Si l’entrée est trop grande mais que la réponse finale peut être condensée, demandez à l’IA de produire une synthèse globale.

Exemple :

Au lieu de soumettre tout un document pour une analyse détaillée, demandez un résumé ou des points clés :

« Donne un résumé de la partie sur les conclusions et recommandations. »

7. Automatiser les tâches avec des pipelines

Pour les projets complexes, mettez en place un pipeline d’analyse où plusieurs requêtes successives sont utilisées pour traiter les informations étape par étape.

Exemple :

- Découpez le texte en chapitres.

- Analysez chaque chapitre séparément.

- Compilez les résultats pour une vue d’ensemble.

Résumé et conclusion

Lorsque la fenêtre contextuelle est insuffisante, il existe plusieurs approches pour optimiser le traitement des informations. Que ce soit en segmentant les données, en fournissant des résumés ou en utilisant des outils de mémoire externe, ces solutions permettent de contourner les limitations techniques de l’IA.

Adapter la stratégie à vos besoins spécifiques, comme la nature de vos données ou vos objectifs, garantit un usage optimal des capacités de ChatGPT et autres modèles d’IA générative.

Pour ne rien rater, abonnez-vous à Cosmo Games sur Google News et suivez-nous sur X (ex Twitter) en particulier pour les bons plans en direct. Vos commentaires enrichissent nos articles, alors n'hésitez pas à réagir ! Un partage sur les réseaux nous aide énormément. Merci pour votre soutien !