Interfaces de chat IA agnostiques : le guide de sélection stratégique 2026

Le marché des interfaces de chat basées sur l’intelligence artificielle a profondément évolué en quelques années. En 2023, la plupart des utilisateurs découvraient les grands modèles de langage à travers des interfaces propriétaires comme ChatGPT ou Claude. En 2026, le paysage est radicalement différent : de nombreuses organisations cherchent désormais à déployer leur propre interface de chat IA, connectée à plusieurs modèles et intégrée à leur système d’information.

Cette évolution s’explique par plusieurs facteurs. Les entreprises souhaitent conserver le contrôle sur leurs données, éviter une dépendance excessive aux fournisseurs cloud et pouvoir orchestrer différents modèles selon les besoins : modèles locaux pour la confidentialité, modèles cloud pour certaines tâches plus complexes. Les interfaces de chat deviennent ainsi une couche d’orchestration entre les utilisateurs, les modèles de langage et les outils métier.

Dans ce contexte, de nouvelles solutions open source ont émergé pour créer des interfaces de chat agnostiques aux modèles. Des plateformes comme LibreChat, Open WebUI ou AnythingLLM permettent de connecter différents moteurs d’inférence (Ollama, vLLM, API cloud) et d’exposer des outils via des standards comme le Model Context Protocol (MCP).

Le choix d’une interface de chat IA n’est donc plus seulement une question d’ergonomie. Il s’agit désormais d’un choix d’architecture et de gouvernance, qui influence la sécurité des données, la traçabilité des interactions et la capacité à faire évoluer la plateforme dans le temps.

Dans ce guide stratégique, nous analysons les principales interfaces de chat IA open source utilisées en 2026 — LibreChat, Open WebUI, AnythingLLM et Chainlit — afin d’identifier leurs forces, leurs limites et les scénarios où chacune peut constituer le meilleur choix.

Pourquoi les interfaces de chat IA sont devenues des composants critiques du SI

Pendant longtemps, les interfaces de chat IA ont été considérées comme de simples outils d’expérimentation. Les développeurs ou les équipes produit utilisaient ces interfaces pour tester des prompts ou interagir ponctuellement avec un modèle de langage.

Cette vision est aujourd’hui dépassée. Dans de nombreuses organisations, les interfaces de chat sont devenues un point d’entrée central vers l’intelligence artificielle.

Une interface unique pour plusieurs modèles

Les entreprises utilisent rarement un seul modèle de langage. Une plateforme moderne peut combiner :

- des modèles locaux pour les données sensibles

- des API cloud pour les tâches complexes

- des modèles spécialisés pour la génération de code, la recherche ou la traduction

Une interface de chat agnostique permet de basculer entre ces modèles sans changer d’outil, ce qui simplifie fortement l’usage pour les utilisateurs.

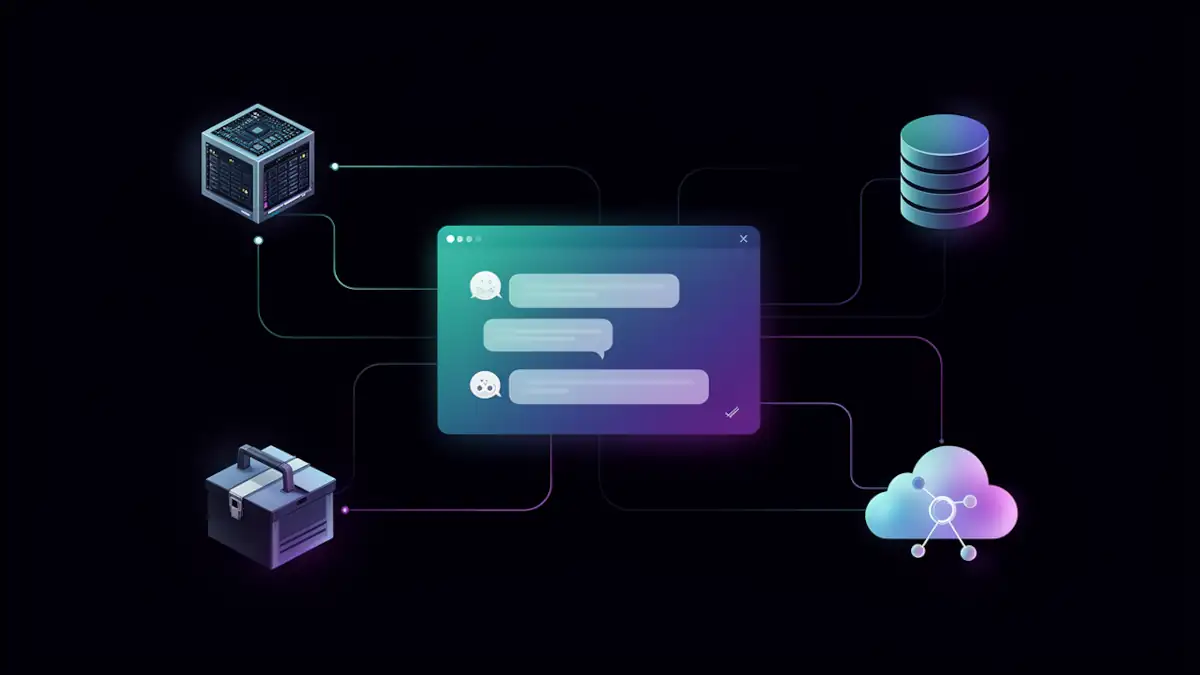

L’émergence des agents et des outils

Les modèles de langage ne se limitent plus à générer du texte. Ils peuvent désormais interagir avec des outils externes :

- systèmes de fichiers

- bases de données

- API internes

- outils DevOps

- applications métier

Ces capacités sont souvent orchestrées à l’aide du Model Context Protocol (MCP), un standard qui permet aux modèles d’accéder à des outils externes de manière structurée.

Pour comprendre comment cette architecture fonctionne dans une stack locale, vous pouvez consulter notre guide sur l’intégration du MCP avec Ollama, vLLM et Open WebUI.

Un enjeu de gouvernance et de conformité

Dès que les interfaces de chat deviennent un outil de travail quotidien, plusieurs questions critiques apparaissent :

- Où sont stockés les prompts et les réponses ?

- Qui peut accéder aux conversations ?

- Les données sensibles sont-elles filtrées ?

- Les interactions sont-elles auditées ?

Ces problématiques transforment les interfaces de chat en composants critiques du système d’information, au même titre qu’un portail interne ou une plateforme collaborative.

Le choix d’une interface ne doit donc pas se limiter à l’ergonomie. Il doit également prendre en compte :

- les capacités d’audit

- l’intégration avec le SSO

- la gestion des permissions

- l’architecture des outils et des agents

C’est précisément ce que nous allons analyser dans la suite de ce guide.

Architecture d’une interface de chat IA moderne

Pour comprendre les différences entre LibreChat, Open WebUI ou AnythingLLM, il faut d’abord comprendre l’architecture typique d’une plateforme de chat IA moderne. Contrairement aux premières interfaces de chatbot, ces solutions ne se limitent plus à envoyer un prompt vers un modèle de langage. Elles servent désormais de couche d’orchestration entre les utilisateurs, les modèles et les outils externes.

Une architecture moderne repose généralement sur trois couches principales : l’interface utilisateur, le moteur d’inférence et les outils ou services externes.

La séparation entre interface, moteurs LLM et outils

L’interface de chat constitue la couche visible pour l’utilisateur. Elle gère l’authentification, les conversations, l’historique et parfois certaines fonctions d’administration comme l’audit ou la gestion des permissions.

Cette interface ne contient généralement pas les modèles de langage eux-mêmes. Elle se connecte à un moteur d’inférence, qui peut être local ou distant. Plusieurs solutions sont couramment utilisées pour servir les modèles :

- Ollama, souvent privilégié pour sa simplicité et sa facilité d’installation

- vLLM, conçu pour maximiser les performances et le débit de génération

- des API cloud comme celles d’OpenAI (documentation OpenAI API), Anthropic ou Google

Dans les environnements professionnels, ces moteurs sont souvent déployés dans des conteneurs ou sur des serveurs GPU dédiés. Si vous souhaitez comprendre comment déployer un backend performant, notre guide explique par exemple comment installer vLLM avec Docker Compose sur Linux et WSL2.

La séparation entre interface et moteur d’inférence offre plusieurs avantages :

- possibilité de changer de modèle sans modifier l’interface

- mutualisation d’un backend GPU pour plusieurs applications

- meilleure gestion des performances et du scaling

Cette architecture modulaire explique pourquoi de nombreuses interfaces de chat sont décrites comme agnostiques aux modèles.

Le rôle du Model Context Protocol (MCP)

La troisième couche de l’architecture concerne les outils et les services externes accessibles par le modèle.

Les modèles de langage peuvent désormais interagir avec des outils comme :

- un système de fichiers

- une base de données

- un moteur de recherche interne

- des API métier

- des services de développement ou de déploiement

Pour structurer ces interactions, l’écosystème IA s’appuie de plus en plus sur le Model Context Protocol (MCP). Ce protocole permet de standardiser la manière dont les modèles découvrent et utilisent des outils externes.

Concrètement, un serveur MCP expose un ensemble d’outils que le modèle peut appeler lorsque cela est pertinent. L’interface de chat agit alors comme un orchestrateur entre le modèle et ces outils.

Certains clients IA, comme Claude Desktop, permettent par exemple d’ajouter facilement des outils via MCP. Notre guide explique en détail comment ajouter un serveur MCP dans Claude Desktop et configurer les connexions locales ou distantes.

Dans une architecture complète, le flux typique devient alors :

utilisateur → interface de chat → moteur LLM → serveur MCP → outil externe

Ce modèle ouvre la voie à des agents IA capables d’agir sur des systèmes réels, ce qui transforme profondément le rôle des interfaces de chat. Elles ne servent plus seulement à dialoguer avec un modèle, mais à orchestrer des workflows complets impliquant plusieurs services.

Comparatif des principales interfaces de chat IA open source

L’écosystème des interfaces de chat IA open source s’est fortement développé depuis l’arrivée des modèles de langage modernes. Plusieurs projets se distinguent aujourd’hui par leur maturité, leur architecture et leur orientation.

Certains privilégient la simplicité et l’accessibilité, tandis que d’autres sont conçus comme de véritables plateformes pour orchestrer des agents et des outils.

Voici un aperçu des principales solutions utilisées en 2026.

| Solution | Positionnement | Support MCP | SSO | Déploiement | Usage idéal |

|---|---|---|---|---|---|

| LibreChat | Plateforme agents | Natif | OIDC/SAML | Docker/Kubernetes | Entreprises + équipes techniques |

| Open WebUI | Interface polyvalente multi-LLM | Via proxy/HTTP | OIDC | Docker (léger) | Chat interne, usage quotidien |

| AnythingLLM | Plateforme RAG/Knowledge base | Intégré (basique) | Simple SSO | Docker | Gestion documentaire, équipes produit |

| Chainlit | Framework code-first | Non (natif) | Custom (code) | Python/Cloud (Vercel, Railway) | Prototypage rapide, apps custom |

Ces outils partagent un objectif commun : offrir une interface capable de dialoguer avec plusieurs modèles et d’intégrer des outils externes. Toutefois, leur philosophie et leurs priorités techniques sont très différentes.

Certaines solutions se concentrent sur la simplicité d’utilisation et le déploiement rapide, tandis que d’autres privilégient la flexibilité architecturale et l’intégration avec des systèmes complexes.

Dans les sections suivantes, nous allons examiner plus en détail les forces et les limites de chacune de ces plateformes afin de comprendre dans quels contextes elles peuvent constituer le meilleur choix.

LibreChat : la plateforme orientée agents et intégrations avancées

Parmi les interfaces de chat IA open source, LibreChat se distingue par une orientation clairement tournée vers l’orchestration d’agents et l’intégration avec des outils externes. Là où certaines interfaces privilégient la simplicité d’utilisation, LibreChat adopte une approche plus proche d’une plateforme d’automatisation IA (documentation LibreChat).

Cette orientation se traduit notamment par une intégration avancée du Model Context Protocol (MCP) et par la présence d’un environnement permettant de définir des agents capables d’utiliser plusieurs outils.

Une architecture pensée pour les agents

LibreChat intègre un système d’Agent Builder qui permet de configurer des assistants spécialisés. Chaque agent peut disposer :

- d’un modèle de langage spécifique

- d’un ensemble d’outils MCP

- d’instructions système dédiées

- de permissions d’accès à certaines ressources

Cette approche est particulièrement intéressante dans les environnements où l’IA doit interagir avec des systèmes internes. Par exemple, un agent peut être configuré pour :

- interroger une base de données interne

- accéder à un dépôt Git

- générer du code

- interagir avec une API métier

Dans ce contexte, l’interface de chat ne sert plus seulement à poser des questions au modèle. Elle devient un point de contrôle pour orchestrer des agents spécialisés.

Un support avancé du Model Context Protocol

LibreChat est aujourd’hui l’une des interfaces open source les plus avancées sur l’intégration du protocole MCP. Les serveurs MCP peuvent être configurés directement dans la plateforme, qu’ils soient :

- locaux

- accessibles via HTTP

- exposés via des transports comme SSE

Cette intégration permet d’exposer des outils au modèle de manière structurée et contrôlée. Elle facilite également la mise en place de workflows complexes impliquant plusieurs services.

Dans des environnements techniques, cette approche permet par exemple de connecter une interface de chat à une stack LLM locale utilisant Ollama ou vLLM, tout en exposant différents outils via MCP.

Authentification et intégration entreprise

LibreChat propose également des mécanismes d’authentification adaptés aux environnements professionnels. La plateforme prend notamment en charge :

- OIDC

- SAML

Ces protocoles permettent d’intégrer l’interface avec un système d’authentification centralisé (Keycloak, Authentik, Azure AD, etc.), ce qui simplifie le déploiement dans un système d’information existant.

Cette capacité est essentielle dans les organisations où l’accès aux outils doit être contrôlé via un SSO centralisé.

Limites et points de vigilance

L’orientation très technique de LibreChat peut également constituer une limite dans certains contextes. La plateforme est particulièrement adaptée aux équipes techniques, mais peut s’avérer plus complexe à administrer pour des organisations recherchant une solution simple à déployer.

De plus, certaines fonctionnalités de gouvernance, comme l’observabilité ou la gestion centralisée des logs, nécessitent souvent l’ajout d’outils externes pour obtenir un niveau de supervision équivalent à celui d’une plateforme enterprise complète.

En résumé, LibreChat s’adresse surtout aux organisations qui souhaitent construire une plateforme d’agents IA flexible et extensible, quitte à accepter une complexité d’exploitation plus élevée.

Open WebUI : l’interface polyvalente pour créer un ChatGPT interne

Alors que LibreChat adopte une approche orientée agents et intégration avancée, Open WebUI s’est imposé comme l’une des interfaces de chat IA les plus populaires pour créer rapidement un équivalent interne de ChatGPT.

Son succès repose sur plusieurs facteurs : une installation relativement simple, une compatibilité avec de nombreux moteurs LLM et une interface utilisateur proche des plateformes commerciales.

Une compatibilité multi-modèles très large

Open WebUI peut se connecter à une grande variété de moteurs d’inférence. Parmi les configurations les plus courantes, on retrouve :

- Ollama pour les modèles locaux

- vLLM pour les environnements haute performance

- des API cloud pour accéder à des modèles propriétaires

Cette compatibilité permet d’utiliser une seule interface pour dialoguer avec différents modèles selon les besoins.

Dans les environnements locaux, il est fréquent d’utiliser Open WebUI comme front-end pour une infrastructure LLM basée sur Ollama ou vLLM, ce qui permet de combiner simplicité d’usage et contrôle sur les données.

Un système d’audit intégré

L’une des forces d’Open WebUI réside dans son système de journalisation. La plateforme peut enregistrer différents niveaux d’informations sur les interactions avec les modèles, notamment :

- les métadonnées des requêtes

- les prompts envoyés au modèle

- les réponses générées

Ces logs peuvent être utilisés pour analyser l’usage de l’IA, détecter certains comportements à risque ou améliorer les prompts utilisés par les équipes.

Dans des environnements professionnels, cette capacité constitue un élément important pour la traçabilité des interactions avec les modèles.

Une intégration progressive des outils et de MCP

Open WebUI supporte également l’intégration d’outils externes, notamment via l’écosystème MCP. Dans de nombreux cas, cette intégration repose sur des composants intermédiaires capables de traduire les outils MCP vers des interfaces compatibles avec l’architecture de la plateforme.

Cette approche permet d’étendre progressivement les capacités du modèle en lui donnant accès à des services externes.

Toutefois, l’architecture d’Open WebUI reste souvent utilisée dans un scénario relativement simple : offrir une interface conviviale permettant aux utilisateurs d’interagir avec différents modèles.

Déploiement et adoption

Open WebUI est souvent choisi pour sa facilité de déploiement. Il peut être installé rapidement dans un conteneur Docker et connecté à différents backends LLM.

Pour les utilisateurs souhaitant expérimenter cette architecture, il est possible de suivre un guide détaillé expliquant comment installer Open WebUI dans un conteneur Docker sur Windows 11 et connecter différents moteurs LLM.

Cette simplicité explique en grande partie pourquoi Open WebUI est devenu l’une des solutions les plus utilisées pour déployer un chat IA interne dans une équipe ou une organisation.

AnythingLLM : une plateforme simple pour le RAG et les bases de connaissances

Alors que LibreChat privilégie l’orchestration d’agents et qu’Open WebUI se positionne comme une interface polyvalente pour interagir avec différents modèles, AnythingLLM adopte une approche légèrement différente. La plateforme est avant tout conçue pour faciliter la création d’assistants capables d’exploiter une base documentaire privée.

Cette orientation en fait une solution particulièrement adaptée aux équipes qui souhaitent utiliser l’IA pour interroger des documents internes, des procédures ou des bases de connaissances (documentation officielle AnythingLLM).

Une approche centrée sur la gestion documentaire

AnythingLLM simplifie la mise en place d’un système de Retrieval-Augmented Generation (RAG). L’idée consiste à combiner un modèle de langage avec un moteur de recherche capable d’extraire les informations pertinentes dans une collection de documents.

Concrètement, la plateforme permet d’importer différents types de contenus :

- documents PDF

- pages web

- fichiers texte

- documentation technique

- bases de connaissances internes

Ces documents sont ensuite indexés afin de permettre au modèle de récupérer les passages les plus pertinents lors d’une requête utilisateur.

Ce mécanisme améliore considérablement la précision des réponses lorsque l’IA doit s’appuyer sur des informations spécifiques à l’organisation.

Une interface conçue pour la simplicité

L’un des principaux avantages d’AnythingLLM est sa simplicité d’utilisation. La plateforme propose une interface claire permettant de gérer :

- les documents indexés

- les espaces de travail

- les modèles utilisés

- les conversations

Cette approche la rend particulièrement attractive pour les équipes produit ou les petites organisations qui souhaitent déployer rapidement un assistant interne basé sur leurs propres données.

Intégration avec les modèles et les outils

AnythingLLM peut se connecter à différents moteurs d’inférence, qu’ils soient locaux ou accessibles via API. Comme les autres interfaces modernes, il peut fonctionner avec plusieurs modèles selon la configuration choisie.

La plateforme prend également en charge des intégrations avec des outils externes et commence à intégrer des fonctionnalités liées à l’écosystème MCP. Toutefois, ces capacités restent généralement moins avancées que celles proposées par des plateformes orientées agents comme LibreChat.

Limites et positionnement

Malgré sa simplicité, AnythingLLM présente certaines limites dans les environnements plus complexes. Les fonctionnalités d’authentification avancée et de gouvernance sont généralement moins développées que dans les solutions conçues pour un déploiement à grande échelle.

En pratique, AnythingLLM constitue souvent un excellent choix pour :

- créer un assistant interne basé sur une documentation

- déployer rapidement un système RAG

- expérimenter des applications IA sans infrastructure complexe

En revanche, les organisations qui souhaitent construire une plateforme agentique plus avancée devront généralement se tourner vers des solutions plus extensibles.

Chainlit : un framework code-first pour prototyper rapidement

Tandis que LibreChat, Open WebUI et AnythingLLM s’adressent principalement à des organisations déployant une interface partagée, Chainlit adopte une philosophie radicalement différente. Ce n’est pas une plateforme complète, mais un framework open source permettant aux développeurs de construire leurs propres interfaces IA en quelques lignes de code Python.

Une approche développeur native

Chainlit transforme le processus de création d’une application IA. Au lieu de configurer une interface graphique, puis de la connecter à un modèle, le développeur écrit simplement des fonctions Python. Chainlit se charge d’exposer une interface Web moderne et réactive autour de ce code.

Voici un exemple simplifié :

import chainlit as cl

from langchain.chat_models import ChatOpenAI

@cl.on_message

async def main(message: str):

chat = ChatOpenAI()

response = await chat.apredict(message)

await cl.Message(content=response).send()

Cette approche présente plusieurs avantages :

- Temps de mise en marché réduit : pas besoin de maîtriser HTML/CSS ou Docker. Le code Python suffit.

- Logique métier centralisée : la chaîne de traitement (prompts, RAG, outils externes) se définit directement dans le code.

- Déploiement flexible : une application Chainlit peut tourner localement, sur un serveur cloud ou même être déployée via Vercel/Railway en quelques clics.

Cette approche attire notamment les équipes de recherche, les startups IA et les consultants qui souhaitent délivrer rapidement un prototype fonctionnel sans infrastructure complexe.

Intégration avec LangChain et outils externes

Chainlit s’intègre naturellement dans l’écosystème LangChain, ce qui signifie que les architectures RAG, les chaînes d’agents et les outils externes se connectent facilement. Un développeur peut écrire une chaîne LangChain, puis l’envelopper dans Chainlit pour offrir une interface utilisateur professional en quelques minutes.

De plus, Chainlit supporte les callbacks et hooks permettant de tracker les interactions, logger les prompts/réponses et intégrer de la télémétrie. Cette capacité facilite la transition d’un prototype vers une application en production.

Cas d’usage idéaux pour Chainlit

Chainlit s’adresse particulièrement à :

- Agences et consultants IA : Livrer rapidement des solutions IA personnalisées aux clients sans investir dans une infrastructure partagée.

- Équipes produit (petites/moyennes) : Créer des assistants spécialisés pour des tâches métier (support client, génération de contenu, analyse documentaire) sans overhead operationnel.

- Chercheurs et data scientists : Exposer des prototypes d’agents ou de RAG avec une interface utilisable, facilitant l’évaluation et les feedback utilisateurs.

- Entreprises en transition IA : Valider rapidement des cas d’usage avant d’engager un déploiement à grande échelle.

Limitations et pièges

Malgré sa flexibilité, Chainlit présente certaines limitations :

- Pas de gouvernance d’entreprise native : Contrairement à LibreChat ou Open WebUI, Chainlit n’intègre pas nativement de système d’audit avancé, de gestion des permissions granulaires ou de SSO. Ces fonctionnalités doivent être ajoutées manuellement via du code.

- Architecture mono-tenant par défaut : Chaque instance Chainlit héberge généralement une seule application. Pour servir plusieurs utilisateurs avec des configurations isolées, une orchestration supplémentaire (Kubernetes, load balancer) devient nécessaire.

- Responsabilité du développeur sur la sécurité : Contrairement aux plateformes fermées, la sécurité de l’application (injection de prompts, accès aux outils, authentification) repose entièrement sur le code du développeur. Une mauvaise implémentation peut créer des failles.

- Pas de support MCP natif (encore) : À l’heure actuelle, Chainlit ne supporte pas nativement le Model Context Protocol. L’intégration d’outils externes repose sur les mécanismes classiques de LangChain ou des fonctions Python personnalisées.

Intégration dans une architecture plus large

Pour les organisations cherchant une approche hybride, Chainlit peut constituer le layer applicatif d’une stack plus grande :

- Backend LLM (Ollama, vLLM) : Exécute les modèles localement.

- Application Chainlit : Définit la logique métier et expose une interface.

- Serveur MCP (optionnel) : Expose des outils externes accessibles via les chaînes LangChain.

- Base de données : Stocke les conversations et l’historique utilisateur.

Cette architecture convient particulièrement aux équipes techniques qui souhaitent construire une application personnalisée et contrôlée tout en conservant la flexibilité des outils open source.

Positionner Chainlit dans le choix stratégique

Le choix entre Chainlit et les autres solutions dépend moins de la complexité technique que du modèle de déploiement :

- Vous cherchez une interface web plug-and-play pour votre équipe ? → Open WebUI ou LibreChat

- Vous avez besoin d’un assistant spécialisé basé sur des documents ? → AnythingLLM

- Vous souhaitez construire une application IA customisée avec un délai court et une équipe de développeurs ? → Chainlit

En résumé, Chainlit n’est pas une alternative à OpenAI ou Anthropic, ni une plateforme « tout-en-un » comme les autres solutions. C’est un outil d’accélération pour les développeurs qui veulent passer d’une idée IA à un produit fonctionnel en quelques jours.

L’infrastructure derrière l’interface : moteurs LLM et performance

Quelle que soit l’interface choisie, les performances d’une plateforme de chat IA dépendent en grande partie du moteur d’inférence utilisé pour servir les modèles de langage.

L’interface joue le rôle de point d’entrée pour les utilisateurs, mais c’est l’infrastructure LLM qui détermine :

- la vitesse de génération des réponses

- la capacité à gérer plusieurs utilisateurs simultanément

- le coût d’exploitation de la plateforme

Les principaux moteurs LLM utilisés en 2026

Plusieurs solutions sont aujourd’hui utilisées pour servir les modèles de langage dans des environnements locaux ou hybrides.

Ollama est souvent choisi pour sa simplicité d’installation. Il permet de télécharger et d’exécuter facilement des modèles open source sur une machine locale, ce qui en fait un outil très populaire pour les environnements de développement.

vLLM, en revanche, est conçu pour maximiser les performances. Son architecture permet d’optimiser l’utilisation du GPU et d’améliorer le débit de génération de tokens, ce qui le rend particulièrement intéressant pour les environnements où plusieurs utilisateurs doivent accéder au modèle simultanément.

Pour comprendre les différences entre ces deux approches, notre comparatif explique en détail comment choisir entre Ollama et vLLM pour servir des modèles LLM en local.

Performance et débit de génération

Dans une plateforme de chat IA, la performance est souvent mesurée à l’aide de plusieurs indicateurs :

- le temps de réponse initial du modèle

- le débit de génération (tokens par seconde)

- la capacité à gérer plusieurs requêtes en parallèle

Les moteurs comme vLLM utilisent différentes techniques pour améliorer ces performances, notamment le batching dynamique et une gestion optimisée de la mémoire GPU.

Dans des environnements professionnels, il est fréquent de déployer ces moteurs sur des serveurs dédiés ou dans des conteneurs afin de mutualiser l’accès aux ressources GPU.

Pour les organisations souhaitant construire leur propre backend LLM, il est par exemple possible de suivre un guide détaillant comment installer vLLM avec Docker Compose sur Linux et WSL2 afin de créer une infrastructure LLM performante.

Une architecture modulaire

L’un des avantages majeurs des interfaces de chat agnostiques est leur capacité à fonctionner avec différents moteurs d’inférence.

Cette modularité permet par exemple de :

- utiliser un modèle local pour certaines tâches sensibles

- basculer vers un modèle cloud pour des tâches plus complexes

- expérimenter plusieurs modèles sans modifier l’interface utilisateur

Dans la pratique, cette séparation entre interface et moteur LLM est l’un des éléments qui permettent aux organisations de conserver un contrôle total sur leur infrastructure IA.

Déployer MCP en production : pièges et bonnes pratiques

Le Model Context Protocol (MCP) joue un rôle de plus en plus central dans les architectures IA modernes. En permettant aux modèles de langage d’interagir avec des outils externes, ce protocole ouvre la voie à des assistants capables d’agir sur des systèmes réels : bases de données, API internes, systèmes de fichiers ou services DevOps.

Toutefois, le passage d’un prototype à un déploiement en production soulève plusieurs défis techniques.

Le choix du transport : stdio, SSE ou HTTP

Les serveurs MCP peuvent utiliser différents mécanismes de transport pour communiquer avec les clients. Historiquement, le mode stdio est souvent utilisé pour les intégrations locales. Il consiste à exécuter un serveur MCP comme un processus enfant, qui communique avec le client via des flux standard.

Ce mode fonctionne très bien pour des environnements de développement ou des intégrations simples. En revanche, il devient plus difficile à gérer lorsque plusieurs utilisateurs ou services doivent accéder simultanément aux outils exposés par MCP.

Dans les architectures distribuées, il est généralement préférable d’utiliser des transports réseau comme SSE ou des implémentations HTTP capables de gérer des flux persistants. Ces approches facilitent la supervision, l’authentification et la mise à l’échelle des services.

Les défis du déploiement dans des environnements cloud

Lorsqu’un serveur MCP doit être exposé dans un environnement de production, plusieurs questions apparaissent rapidement :

- comment isoler les outils accessibles par le modèle

- comment limiter les permissions accordées aux agents

- comment superviser les appels aux outils

- comment éviter les abus ou les appels accidentels à certaines API

Ces questions sont particulièrement importantes lorsque les agents IA peuvent interagir avec des systèmes sensibles.

L’écosystème MCP évolue rapidement pour répondre à ces problématiques, mais il reste essentiel de mettre en place des mécanismes de sécurité adaptés, notamment pour contrôler l’accès aux outils et auditer les interactions.

Une analyse plus approfondie de ces enjeux est présentée dans notre article consacré à la sécurisation de l’écosystème MCP et des agents IA dans les environnements modernes.

Observabilité et gouvernance

Au-delà de la sécurité, un autre défi majeur concerne l’observabilité. Lorsqu’un modèle peut appeler plusieurs outils, il devient indispensable de pouvoir suivre précisément :

- les requêtes envoyées au modèle

- les outils utilisés par les agents

- les résultats retournés par ces outils

Ces informations permettent non seulement d’identifier d’éventuels problèmes, mais aussi d’améliorer progressivement les workflows IA.

Dans les architectures avancées, ces données sont souvent collectées par des systèmes de logs ou des plateformes d’observabilité externes.

Comment choisir la bonne interface de chat IA selon votre contexte

Face à la diversité des solutions disponibles, il peut être difficile de déterminer quelle interface correspond le mieux à un besoin particulier. En réalité, le choix dépend principalement du rôle que l’IA doit jouer dans l’organisation.

Créer un équivalent interne de ChatGPT

Certaines organisations souhaitent simplement offrir aux équipes un assistant IA interne, capable de dialoguer avec différents modèles tout en conservant les données dans l’infrastructure de l’entreprise.

Dans ce scénario, Open WebUI constitue souvent l’une des solutions les plus simples à déployer. Son interface familière et sa compatibilité avec de nombreux moteurs LLM permettent de mettre en place rapidement un environnement de chat IA accessible à toute une équipe.

Construire une plateforme d’agents IA

Lorsque l’objectif est d’automatiser des tâches ou d’orchestrer des outils via des agents IA, des plateformes plus extensibles deviennent nécessaires.

Dans ce contexte, LibreChat se distingue par son intégration avancée du protocole MCP et par ses fonctionnalités orientées agents. La plateforme permet de définir des assistants spécialisés capables d’interagir avec plusieurs outils et services.

Déployer un assistant basé sur une base documentaire

Pour les organisations qui souhaitent exploiter leurs documents internes — procédures, documentation technique ou bases de connaissances — une solution orientée RAG peut être plus adaptée.

AnythingLLM offre une approche particulièrement simple pour construire ce type d’assistant. La plateforme permet d’importer facilement des documents et de les exploiter via un modèle de langage.

Développer des applications IA personnalisées

Pour les équipes techniques souhaitant construire leurs propres interfaces sur mesure, Chainlit offre une approche rapide basée sur du code Python. Contrairement aux plateformes fermées, Chainlit permet une personnalisation complète tout en minimisant le temps de déploiement. Cette approche convient particulièrement aux :

- Agences IA livrant des solutions aux clients

- Startups cherchant à valider rapidement un cas d’usage

- Équipes produit développant un assistant interne spécialisé

Pour les architectures plus complexes nécessitant une gouvernance avancée et une scalabilité multi-utilisateur, les plateformes comme LibreChat restent préférables.

Vers des plateformes IA complètes plutôt que de simples interfaces

Les interfaces de chat IA ont profondément évolué en quelques années. Ce qui n’était au départ qu’un simple moyen d’interagir avec un modèle de langage est devenu une véritable plateforme d’orchestration pour l’intelligence artificielle.

Les organisations utilisent désormais ces interfaces pour connecter plusieurs modèles, intégrer des outils externes et automatiser certaines tâches à l’aide d’agents. Dans ce contexte, des standards comme le Model Context Protocol jouent un rôle croissant pour structurer les interactions entre les modèles et les systèmes externes.

Cette évolution transforme progressivement les interfaces de chat en composants centraux des architectures IA modernes. Le choix d’une plateforme ne doit donc pas se limiter à l’ergonomie ou aux fonctionnalités visibles. Il doit également prendre en compte l’architecture technique, les mécanismes de gouvernance et la capacité de la solution à évoluer avec les besoins de l’organisation.

Pour les équipes qui souhaitent expérimenter ou construire leur propre infrastructure IA, les solutions open source offrent aujourd’hui un niveau de maturité suffisant pour mettre en place des plateformes puissantes et flexibles.

Le véritable enjeu n’est plus seulement de dialoguer avec un modèle de langage, mais de concevoir une architecture capable d’exploiter pleinement le potentiel des agents et des outils connectés à l’IA.

Pour ne rien rater, abonnez-vous à Cosmo Games sur Google News et suivez-nous sur X (ex Twitter) en particulier pour les bons plans en direct. Vos commentaires enrichissent nos articles, alors n'hésitez pas à réagir ! Un partage sur les réseaux nous aide énormément. Merci pour votre soutien !