LTX-2.3 vs Wan-2.2 : quel modèle vidéo IA open source choisir en 2026 ?

L’arrêt de Sora en 2026 n’était pas qu’un changement de produit, c’était un signal d’alarme : dépendre d’un seul géant pour sa création vidéo est un risque. Alors que les alternatives propriétaires deviennent hors de prix, les créateurs avisés se tournent vers le Local-First.

Mais face à vous, deux mondes s’affrontent. LTX-2.3 promet la vitesse et le format natif mobile, avec un audio natif (bien que perfectible). Wan-2.2 offre un meilleur rendu cinématographique, plus détaillé, mais sans audio. Dans ce guide, nous tranchons : quel modèle est vraiment fait pour votre machine et votre style ? Ou encore comment utiliser les deux modèles conjointement pour obtenir le meilleur des deux mondes.

Au-delà de la simple performance technique, se pose la question cruciale de l’avenir : avec le passage de Wan à des modèles comme la 2.7, exclusivement accessibles via API ou abonnements payants, l’open weight est-il une solution pérenne ou une fenêtre d’opportunité éphémère ? Pour comprendre les raisons de ce séisme, nous vous invitons à lire notre analyse sur l’arrêt de Sora par OpenAI.

1. LTX-2.3 : L’agilité audiovisuelle et le règne du format court

LTX‑2.3, développé par Lightricks, est un modèle vidéo open‑weight basé sur une architecture DiT, capable de générer vidéo et audio synchronisés, avec un support natif du format vertical 9:16.

La suprématie du 9:16 natif

C’est l’argument massue de LTX-2.3 : il comprend nativement la composition spatiale du format portrait (9:16). Contrairement à d’autres modèles ou encore à la versoin précédente LTX-2.0 qui se contentent de recadrer une image paysage (crop), LTX-2.3 génère des perspectives et des mouvements de caméra pensés pour les smartphones. C’est, à l’heure actuelle, le meilleur choix pour automatiser des flux de production destinés à TikTok, Reels ou YouTube Shorts.

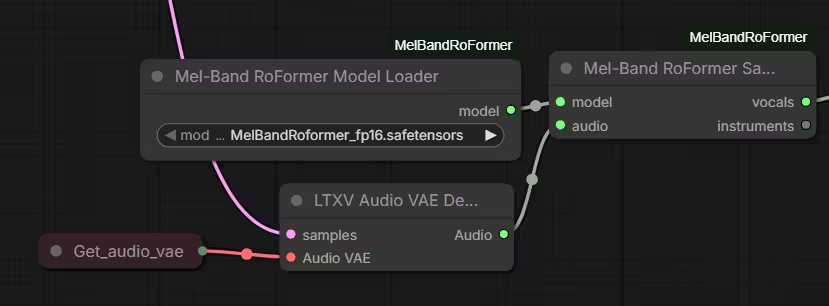

Audio natif et synchronisation : promesses vs réalité

LTX-2.3 intègre un pipeline de génération audio synchronisé. Si l’idée de sortir une vidéo avec une piste audio en une seule passe est séduisante, la réalité technique est plus nuancée. La qualité audio reste variable et sert davantage d’ambiance témoin ou de base de travail.

- Génération de voix : si la synchronisation est bonne, la qualité de la voix générée est médiocre. Son métallique et manque d’émotion, le modèle ne rivalise pas avec les meilleurs TTS Open Weight. Soit vous faites des concessions, soit il faut retravailler l’audio en amont ou en aval.

- Génération de bruitage : le modèle génère aussi les ambiances et bruitages, mais reste également très brouillon sur ce point.

- Génération de musique : mauvaise qualité, c’est plutôt un point négatif. Le modèle a tendance à ajouter de la musique alors que vous n’en voulez pas. La solution d’exclure la musique via le prompt (positif ou négatif) ne fonctionne pas. Il faut donc recourir à une solution de post-production, comme indiqué sur la page de discussion du modèle.

En connaissance de cause, il est inévitable de travailler les pistes audio séparément pour un rendu professionnel. Vous pouvez soit accepter la qualité « maquette » de l’audio natif pour un travail rapide, soit privilégier des workflows Audio-to-Vidéo (A2V) pour plus de contrôle.

Support 4K et limites de l’inférence locale

Le modèle affiche fièrement un support 4K, mais attention au mirage technique. En local, générer nativement en 4K sature instantanément les pipelines, même sur des configurations musclées. Dans la pratique, LTX-2.3 excelle en 720p ou 1080p, offrant une rapidité d’exécution qui permet d’itérer dix fois plus vite que sur ses concurrents.

Pour obtenir de la 4K, l’utilisation de Workflow d’upscaling avec des modèles dédiés est une solution viable.

Optimisation VRAM et accessibilité

Pour exploiter LTX-2.3 sans heurts, la gestion des ressources est la clé. Il est fortement recommandé de consulter notre dossier pour bien choisir la taille de modèle adaptée à votre VRAM, car l’activation simultanée des modules vidéo et audio peut rapidement mener à l’OOM (Out Of Memory) sur des cartes de moins de 16 Go.

2. Wan-2.2 : Le poids lourd du photoréalisme cinématographique

Si LTX-2.3 est le sprinter du format court, Wan-2.2 (issu des laboratoires d’Alibaba) à l’avantage sur la qualité du rendu et des détails. Basé sur une architecture de pointe en Mixture-of-Experts (MoE), ce modèle ne se contente pas de déplacer des pixels ; il simule une physique de la lumière et des textures.

Comprendre les variantes : 14B vs 5B

Le projet Wan-2.2 se décline en deux versions principales :

- 14B (Complet) : La version de référence pour le photoréalisme. Elle gère bien les textures de peau, les reflets et la dynamique des fluides. Toutefois, le modèle a ses limites sur la bonne compréhension de la physique. Un verre avec de l’eau qui se casse, un combat de boxe ou d’autres situations avec une physique complexe, seront à éviter.

- 5B (Optimisé) : C’est la version de survie pour l’usage en local sur de petite configuration (petite pour l’IA !). Elle offre un compromis acceptable, bien qu’elle perde une partie de la finesse structurelle de sa grande sœur. Pour bien utiliser ce modèle, il est nécessaire de viser une image minimaliste ou encore un dessin animé afin d’obtenir un rendu satisfaisant.

L’exigence hardware et la lenteur d’inférence

Ne nous trompons pas : Wan-2.2 est un modèle exigeant. Son architecture MoE, bien que brillante, se traduit par une performance d’inférence lente par rapport aux modèles DiT classiques. Pour un rendu fluide sans saccades temporelles, une carte graphique de 24 Go de VRAM est le ticket d’entrée confortable. Sur des configurations plus modestes, l’optimisation logicielle est obligatoire pour éviter que votre workflow local vidéo IA ne s’arrête brusquement.

Le salut par les formats GGUF et FP8

Pour faire tourner un tel mastodonte sur des stations de travail, le passage par la compression est inévitable. La communauté a massivement adopté les versions quantifiées pour maintenir la qualité tout en réduisant l’empreinte mémoire. Il est crucial ici de comprendre les nuances entre les formats FP8, FP16 et GGUF pour minimiser la perte de rendu visuel. Plus spécifiquement, l’utilisation de l’optimisation GGUF sous ComfyUI est aujourd’hui la méthode la plus robuste pour charger Wan-2.2 sur des GPU de 12 à 16 Go de VRAM avec des compromis acceptables.

3. Synthèse : Tableau comparatif LTX-2.3 vs Wan-2.2

Voici les données techniques réelles constatées lors de nos tests sur une configuration RTX 50-Series (2026).

| Caractéristique | LTX-2.3 | Wan-2.2 |

|---|---|---|

| Architecture | DiT (Diffusion Transformer) | MoE (Mixture-of-Experts) |

| Résolution réaliste | 1080p (Portrait/Paysage) | 720p (à upscaler) |

| FPS Natif | 24 – 30 FPS | 16 – 24 FPS |

| Durée max (Clip) avec VRAM limitée | ~10 secondes | ~5 secondes |

| VRAM limitée recommandée | 16 Go | 24 Go |

| Durée max avec 32 Go VRAM | ~20 secondes | ~15 secondes |

| Audio intégré | Oui (Qualité maquette) | Non |

| Usage principal | TikTok, Shorts, Itérations rapides | Cinématique, VFX, Photoréalisme |

- valeurs observées, variables selon GPU et workflow

4. Quel modèle choisir selon votre usage ?

Le choix de votre modèle vidéo IA local ne doit pas se faire sur la simple esthétique, mais sur l’adéquation entre votre hardware et votre objectif final. Voici nos recommandations basées sur les flux de production actuels :

- TikTok / Shorts / Reels → LTX-2.3 : C’est le choix de la rentabilité. Sa capacité à générer nativement en 9:16 vous évite des manipulations de cadrage, et sa rapidité permet de tester plusieurs variantes de prompts en un temps record. L’audio natif, bien que perfectible, offre un avantage certain pour les formats courts où le son est souvent secondaire ou facilement remplaçable.

- YouTube / Projets Cinématiques → Wan-2.2 : Si vous visez le grand écran (16:9) et le photoréalisme, Wan est la référence. Prévoyez toutefois un temps de rendu plus long et un pipeline de post-production incluant un upscale externe.

- Animation fluide et organique → Mochi 1 : Pour des mouvements ultra-fluides sans l’aspect « morphing » parfois présent chez les autres, c’est l’alternative à privilégier pour des clips courts.

- Test de prompt et « Drafting » → Pyramid Flow : Avant de lancer un rendu définitif sur Wan-2.2 qui pourrait durer 15 minutes, utilisez Pyramid Flow pour valider votre mise en scène et vos couleurs en quelques secondes.

5. Les challengers : Mochi 1 et Pyramid Flow

L’écosystème ne se limite pas au duel LTX/Wan. En 2026, deux autres noms reviennent systématiquement dans les discussions.

Mochi 1 (Genmo) : La fluidité avant tout

Développé par Genmo, Mochi 1 se positionne sur une niche précise : la fluidité de mouvement.

- Performance : Il génère des clips de 5 secondes environ avec une résolution modeste tournant autour de 480p.

- Positionnement : Ce n’est pas un modèle de rendu final pour de la 4K, mais un outil exceptionnel de prototypage et d’animation. Si votre scène demande une physique complexe (tissus, fluides), Mochi 1 surpasse souvent ses concurrents plus lourds. Il peut être utilisé dans Workflow LTX ou Wan comme référence (Video To Vidéo, V2V).

Pyramid Flow : Le roi du drafting

Pyramid Flow est l’outsider le plus rapide du marché.

- Usage : Il est conçu pour le drafting (brouillon). Son architecture lui permet de générer des aperçus visuels presque instantanément.

- Limites : Il n’est pas destiné à la production finale. La qualité des détails est insuffisante pour un projet professionnel, mais il est indispensable pour économiser des cycles de calcul précieux lors de la phase de recherche créative.

6. Perspectives et licences : Que reste-t-il à l’Open Source ?

Le retrait de Sora a prouvé qu’aucun géant n’est à l’abri d’un changement de cap économique. Cette situation renforce la valeur des modèles dont on possède les « poids » (Open Weights). Plus globalement le retrait de Sora confirme la nécessité des modèles spécialisés et démontre la complexité de la rentabilité même pour les grands acteurs.

Cependant, une tendance inquiétante se dessine : les versions les plus abouties de Wan (2.7) ou les futurs moteurs de Lightricks ont tendance à migrer vers des modèles hybrides où seule la version « Lite » reste gratuite. Pour compenser ces limitations de résolution ou de durée, le salut des créateurs locaux passe par le post-traitement.

L’utilisation conjointe de la RTX Video Super Resolution dans ComfyUI pour l’Upscaling quasiment en temps réel et de l’Upscale sous ComfyUI pour le rendu final permet aujourd’hui de transformer un clip 720p issu de Wan-2.2 en une séquence 4K de qualité.

Optimisation du flux de travail : L’interpolation de frames Une avancée récente dans ComfyUI via le template « Video Frame Interpolation » permet d’optimiser significativement la fluidité sans alourdir le générateur principal. En utilisant des modèles spécialisés comme FILM (Frame Interpolation for Large Motion de Google) ou Practical-RIFE, il est possible d’augmenter le taux d’images par seconde (FPS) post-génération. Cette technique, accessible via les modèles hébergés par Comfy-Org, est devenue un standard pour lisser les mouvements tout en préservant l’intégrité des pixels générés par les modèles lourds comme Wan-2.2. Pour une comparaison plus technique et détaillée, je vous invite à consulter cet article.

Pour rester à l’affût des dernières optimisations communautaires, surveillez régulièrement les hubs où l’on peut trouver et télécharger les meilleurs modèles IA.

Conseil : utiliser la génération de vidéo IA en local est une solution viable, elle nécessite cependant de bonnes connaissances techniques, du temps et également du matériel (quantité de VRAM). Un point crucial pour obtenir des vidéos satisfaisante est de connaitre les limites des modèles. Construire également des workflows complémentaires pour l’upscaling, l’interpolation ou encore la génération d’audio, est essentiel pour s’approcher d’une qualité professionnel. La phase de montage est essentielle, c’est elle qui permettra à votre contenu de se différencier et d’ajouter la touche humaine nécessaire. Des outils de montage gratuits, comme Capcut, sont parfaits pour obtenir des vidéos dynamiques, ajouter du texte et améliorer sa productivité avec des fonctionnalités IA.

FAQ : Tout savoir sur les modèles vidéo IA en 2026

Quel est le meilleur modèle vidéo IA open source en 2026 ?

Le choix dépend de votre objectif de production. Pour la création de contenus verticaux rapides et synchronisés (TikTok, Reels), LTX-2.3 est le leader incontesté grâce à son format 9:16 natif. Pour des projets nécessitant un photoréalisme de haut niveau et une esthétique cinématographique, Wan-2.2 reste la référence absolue malgré sa lenteur d’inférence.

Quelle est la différence fondamentale entre LTX-2.3 et Wan-2.2 ?

La différence réside dans l’architecture et la finalité. LTX-2.3 utilise un Diffusion Transformer (DiT) optimisé pour la vitesse et le format portrait avec audio intégré. Wan-2.2 repose sur une architecture Mixture-of-Experts (MoE) beaucoup plus lourde, privilégiant la précision des textures et la cohérence de la lumière au détriment de la rapidité et de la légèreté.

Quelle est la durée maximale d’une vidéo générée par ces modèles ?

En une seule passe, ces modèles génèrent généralement entre 5 et 10 secondes de mouvement fluide (souvent 16 à 25 frames), jusqu’à un maximum de 20 secondes si vous disposez de suffisamment de VRAM, mais avec le risque d’artefacts et de déformation. Pour dépasser cette limite, on utilise le Context Shifting dans ComfyUI : cette technique fait glisser une fenêtre d’attention sur une timeline plus longue pour maintenir la cohérence. Attention toutefois à la dérive sémantique (semantic drift) qui peut altérer les détails du personnage sur des durées prolongées.

Pour améliorer la fluidité, l’utilisation de nœuds d’interpolation de frames (comme FILM ou RIFE) permet de multiplier le nombre d’images par seconde (FPS). Cela lisse le mouvement et donne un aspect plus cinématique sans demander un effort de génération supplémentaire au modèle de base.

L’audio est-il vraiment de bonne qualité dans les modèles vidéo ?

Seul LTX-2.3 propose un pipeline audio natif sérieux en 2026. Cependant, la qualité reste celle d’une « maquette » sonore. Elle est excellente pour la synchronisation des mouvements de base, mais pour un projet professionnel, il est conseillé de l’utiliser comme guide pour un design sonore plus complexe réalisé avec des outils spécialisés.

Pour ne rien rater, abonnez-vous à Cosmo Games sur Google News et suivez-nous sur X (ex Twitter) en particulier pour les bons plans en direct. Vos commentaires enrichissent nos articles, alors n'hésitez pas à réagir ! Un partage sur les réseaux nous aide énormément. Merci pour votre soutien !