Vidéo IA locale sur RTX : comprendre le workflow NVIDIA (LTX-2.3 et FLUX)

La génération vidéo IA locale franchit un cap important en 2026. Avec son blueprint « RTX AI Video Generation », NVIDIA ne se limite plus à transformer des prompts en clips animés : la marque propose un workflow hybride qui combine la précision de la 3D (Blender) et la puissance des GPU RTX.

Ce pipeline introduit une approche plus structurée, où la composition, la caméra et la profondeur sont définies en amont, offrant un niveau de contrôle bien supérieur aux méthodes Text-to-Video ou Image-to-Video.

Encore exigeant et partiellement expérimental, il marque néanmoins une évolution majeure vers des outils de création plus maîtrisés et exploitables en local.

L’ère de la vidéo IA contrôlée

Jusqu’à présent, la génération vidéo IA locale reposait largement sur des approches de type Text-to-Video (T2V) ou Image-to-Video (I2V). Rapides à mettre en œuvre, ces méthodes restent toutefois limitées : l’IA interprète librement les volumes, la perspective peut dériver, et les mouvements de caméra restent difficiles à maîtriser.

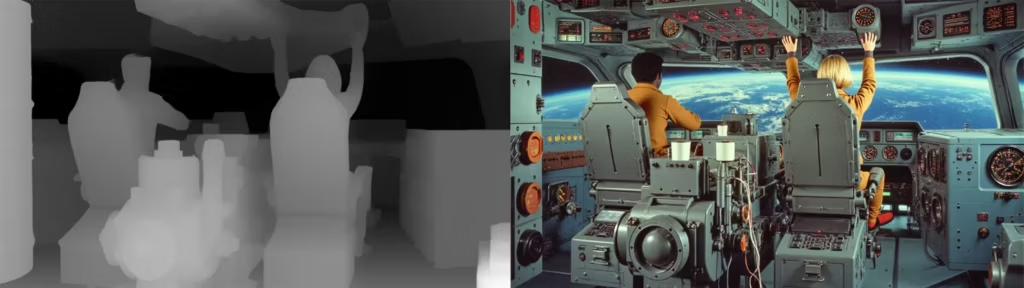

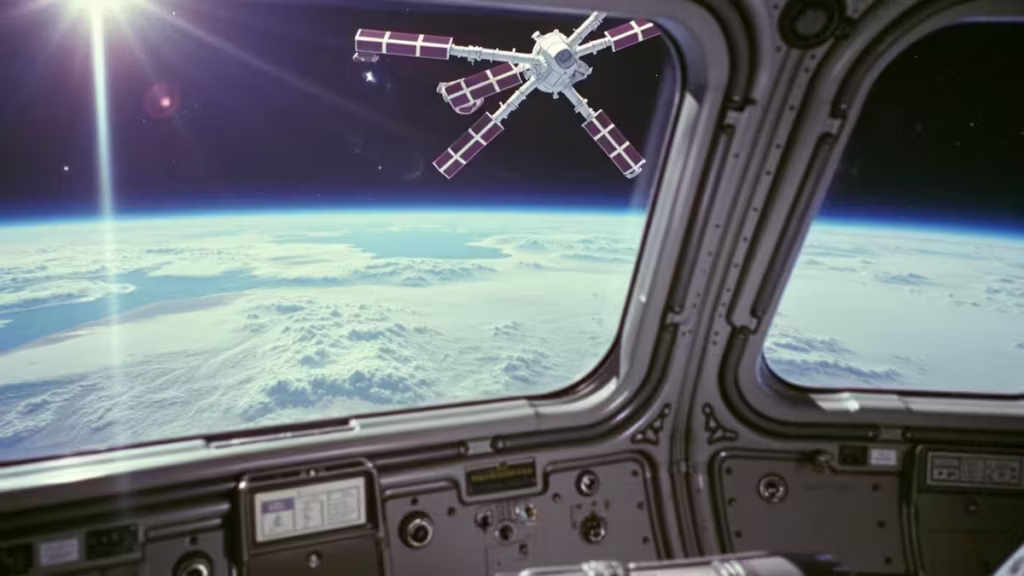

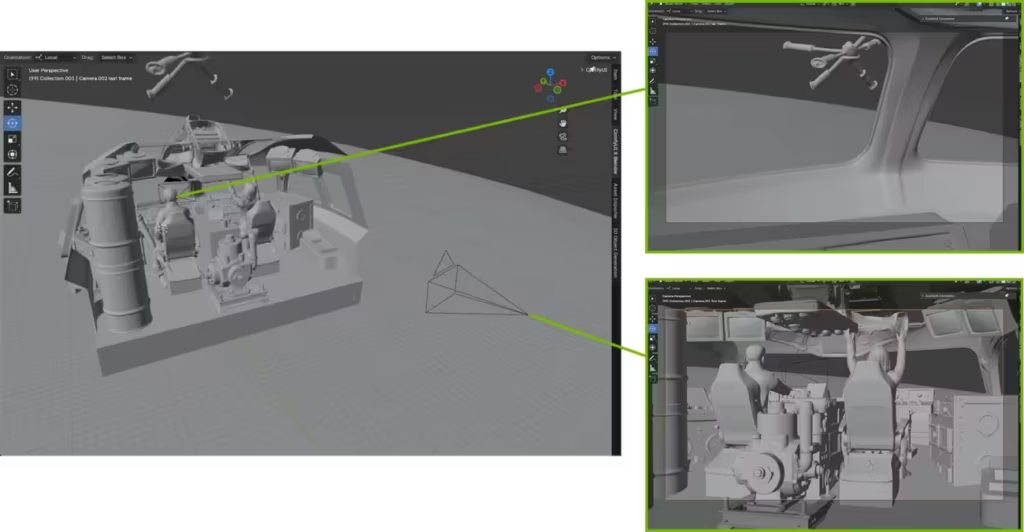

Le blueprint « RTX AI Video Generation » introduit une approche différente : une vidéo IA dirigée par la 3D. Au lieu de partir d’un simple prompt ou d’une image, le workflow commence par la création d’assets 3D, ensuite intégrés dans Blender pour construire la scène, définir la caméra, la lumière et la composition.

Cette étape change profondément la logique de production. On ne génère plus un clip isolé, mais une scène structurée reposant sur des objets réutilisables, ce qui permet de maintenir une cohérence visuelle entre plusieurs plans. Là où un pipeline I2V classique “interpole” à partir d’une image fixe, cette approche s’appuie sur une géométrie explicite pour réduire les incohérences de perspective et de mouvement, sans pour autant les éliminer totalement.

Le pipeline repose ensuite sur plusieurs briques complémentaires :

- FLUX.1 Depth, pour générer des images cohérentes avec la structure spatiale,

- LTX-2.3, pour l’animation entre keyframes et la gestion temporelle (avec support audio),

- et le SDK RTX Video, pour l’upscaling final.

Mais derrière ce gain de contrôle, la réalité reste exigeante. Le workflow demeure expérimental, avec des contraintes strictes (frames, graph ComfyUI, stabilité temporelle) et une dépendance partielle à l’écosystème RTX / Windows pour certaines optimisations. Ce guide propose de décortiquer chaque étape pour comprendre ses apports, ses limites, et déterminer s’il correspond à votre usage.

(cliquez pour agrandir)

1. Comprendre le pipeline : L’architecture du workflow « RTX AI Video »

Le secret de ce blueprint réside dans sa structure modulaire. Chaque étape prépare le terrain pour la suivante, garantissant que l’IA ne s’écarte jamais de votre vision créative originelle.

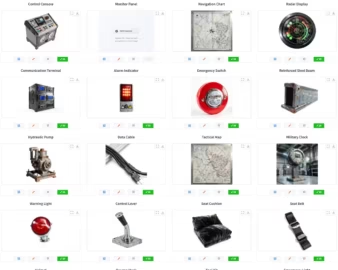

1.1 La genèse 3D : TRELLIS, SANA et la pérennité des assets

L’ajout majeur de ce blueprint est l’intégration du pipeline « 3D Object Generation ». Au lieu de simplement générer une image plate, l’utilisateur crée d’abord des objets tridimensionnels réels à l’aide des modèles TRELLIS et SANA.

- Réutilisation et cohérence multi-plans : Contrairement à la génération d’images classique où chaque « seed » produit un objet légèrement différent, disposer d’un asset 3D réel permet de le placer dans différentes scènes ou sous différents angles de caméra. Cela garantit une cohérence du sujet (personnage, accessoire ou décor) entre plusieurs plans d’un même projet.

- Contrôle de la topologie : Le réglage Sparse Structure Sampling Steps permet de définir la propreté du maillage (mesh), assurant que les silhouettes restent nettes une fois importées dans Blender.

- Texture et lumière : Les Latent Sampling Steps pilotent la finesse des détails de surface. Une fois l’asset généré, il peut être éclairé dynamiquement dans Blender, offrant une flexibilité que le « Image-to-Video » traditionnel ne permet pas.

L’intérêt est double : on ne se contente plus de générer des pixels, on constitue une bibliothèque d’assets numériques exploitables à l’infini. Dans une optique de court-métrage, c’est la seule méthode viable pour s’assurer que votre protagoniste ou votre décor ne change pas d’apparence entre deux coupes de montage. C’est le passage d’une IA « illustratrice » à une IA « accessoiriste et décoratrice ».

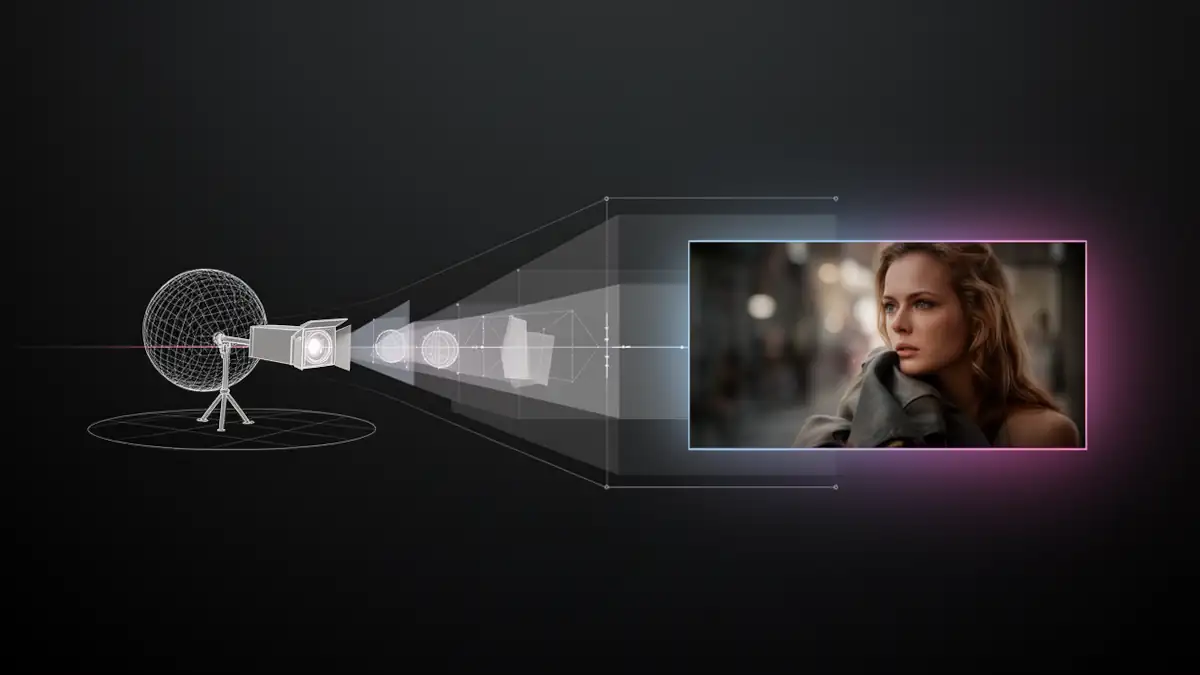

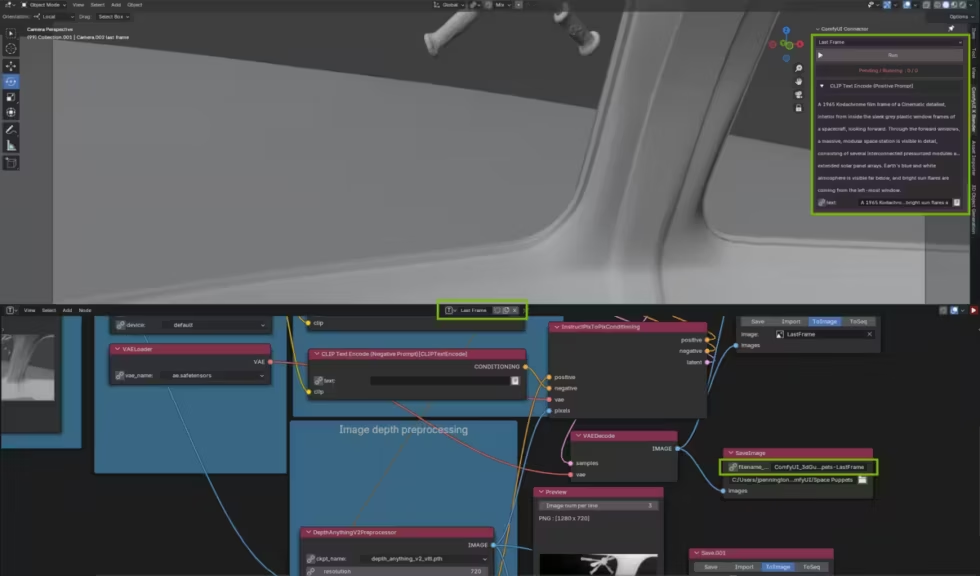

1.2 Le guidage spatial : FLUX.1 Depth et Blender

Une fois les objets importés dans Blender (version 4.2 ou 4.5 LTS), vous définissez votre mise en scène : position des éléments, trajectoire de caméra et éclairage. Blender sert ici de base de composition, mais il ne génère pas directement les images finales.

Le rôle de FLUX.1 Depth est justement d’introduire une compréhension de la profondeur dans la génération d’image. Contrairement à un modèle classique, il est capable de produire des images en cohérence avec une structure spatiale implicite, en générant lui-même une représentation de profondeur. Au lieu de laisser l’IA imaginer la profondeur, on lui impose celle de la scène 3D via une carte de profondeur (Depth Map).

Blender définit la structure globale de la scène (composition, perspective, cadrage). FLUX.1 Depth génère les images en respectant cette logique spatiale, en s’appuyant sur sa propre modélisation de la profondeur. Cette approche permet d’éviter les artefacts fréquents du “prompt-only”, comme les incohérences de perspective ou les objets flottants.

Dans ce workflow, Blender agit comme un outil de direction artistique, tandis que FLUX.1 Depth assure la cohérence géométrique pour la génération de vidéo.

C’est à cette étape que sont produites les keyframes (images de début et de fin), qui serviront ensuite de base au modèle vidéo.

- Le modèle FLUX.1 Depth utilise cette carte comme un moule pour générer des images photoréalistes.

- Cela garantit que chaque élément reste à sa place, respectant la perspective et les occultations.

- C’est ici que l’on génère les « keyframes » (images clés) de début et de fin qui serviront de piliers à la vidéo.

Point important : FLUX.1 Depth n’est pas un simple consommateur de depth maps externes, mais un modèle conçu pour intégrer la notion de profondeur directement dans la génération, ce qui le distingue des approches type ControlNet.

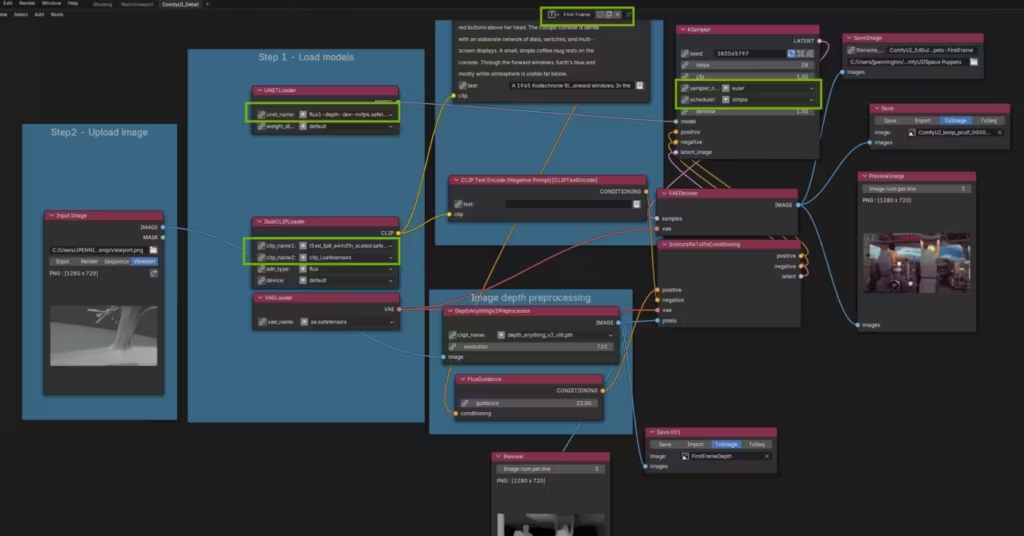

1.3 L’animation temporelle : LTX-2.3 et le système de Keyframes

Le moteur d’animation vidéo est confié à LTX-2.3, un modèle de diffusion vidéo capable de relier les deux images clés de manière fluide, tout ajoutant de l’audio synchronisée à la vidéo.

- L’utilisateur injecte le First Frame et le Last Frame dans ComfyUI.

- Un prompt en langage naturel décrit le mouvement souhaité entre ces deux points et l’audio.

- Le système est optimisé pour des séquences de 5 secondes (environ 121 frames), assurant une cohérence visuelle maximale avant que le modèle ne commence à diverger.

Note : l’add-on ComfyUI Blender AI Node permet d’exécuter ComfyUI en arrière-plan et d’afficher ses nœuds directement dans l’interface de Blender. C’est surprenant car, habituellement, ces deux logiciels fonctionnent séparément. Cette intégration est stratégique pour plusieurs raisons :

- Synchronisation en temps réel : La carte de profondeur (Depth Map) générée par le moteur de rendu de Blender est envoyée instantanément au modèle FLUX.1 Depth sans export manuel.

- Contrôle spatial : Le créateur peut manipuler ses objets 3D et voir le résultat de l’IA se mettre à jour dans une fenêtre adjacente, transformant Blender en une interface de pilotage pour l’IA.

- Automatisation : Cela permet de lier des paramètres 3D (comme le mouvement de la caméra) à des paramètres de génération IA (comme l’intensité du mouvement LTX-2.3) au sein d’un même environnement de travail.

L’utilisation séparée de ComfyUI avec des exports de Depth Maps est tout à fait possible et offre un contrôle granulaire sur chaque nœud du graph. Cependant, l’intégration directe dans l’interface de Blender via l’add-on dédié répond à trois besoins critiques du blueprint NVIDIA : l’instantanéité du feedback, la cohérence des métadonnées, l’automatisation du pipeline.

2. Configuration matérielle : De quoi avez-vous réellement besoin ?

Faire tourner un studio d’animation IA en local ne s’improvise pas. Si le marketing de NVIDIA met en avant ses fleurons, la réalité du terrain en 2026 permet une certaine flexibilité, à condition de savoir où placer le curseur de la performance.

2.1 Tableau comparatif : Configuration minimale vs Recommandée

Pour ce pipeline spécifique combinant 3D, FLUX et LTX-2.3, voici les paliers matériels observés :

| Composant | Configuration minimale (1080p / 720p) | Configuration recommandée (4K / Pro) |

|---|---|---|

| GPU (NVIDIA RTX) | 12 Go VRAM (RTX 4070 / 5070) | 16 à 32 Go VRAM (RTX 5070 Ti / 5090) |

| RAM système | 32 Go | 64 Go |

| Processeur | Intel i7 / Ryzen 7 (dernière génération) | Intel i9 / Ryzen 9 |

| Stockage | SSD NVMe (50 Go libres pour les modèles) | SSD NVMe dédié |

| Système d’exploitation | Windows 10 / Linux (support partiel) | Windows 11 (requis pour VSR / NVFX) |

Conseil : Bien qu’il soit possible de lancer le workflow avec 12 Go de VRAM, vous devrez sacrifier la résolution de sortie ou utiliser une quantification agressive. Pour une expérience fluide, choisir la taille de son modèle en fonction de sa VRAM reste l’étape cruciale avant tout rendu.

2.2 Le cas Blackwell et le format NVFP4

L’une des grandes nouveautés de ce blueprint est l’utilisation du format NVFP4 pour le modèle FLUX.1 Depth.

- Optimisation Blackwell : Ce format de quantification 4-bits est conçu pour les Tensor Cores de la série RTX 50, permettant de diviser presque par deux l’empreinte mémoire par rapport au FP8.

- Gain de performance : Il offre un débit d’inférence supérieur, essentiel pour générer des keyframes rapidement.

- Nuance technique : Si vous possédez une carte de génération précédente (série 30 ou 40), le pipeline reste fonctionnel en utilisant des formats comme le FP8, le BF16 ou le GGUF, bien que plus gourmands en ressources. Pour approfondir ce sujet, consultez notre dossier sur le format IA NVFP4.

2.3 OS et drivers : Le dilemme Windows vs Linux

C’est ici que le bât blesse pour les puristes de l’open-source.

- Windows 11 obligatoire pour le VSR : Le RTX Video Super Resolution (NVFX) est intrinsèquement lié aux drivers Windows et aux API DirectX/Vulkan de NVIDIA.

- Le cas Linux : Vous pouvez parfaitement faire tourner ComfyUI, FLUX et LTX-2.3 sous Linux. Cependant, vous perdrez l’accès au nœud d’upscale propriétaire NVIDIA, vous obligeant à vous rabattre sur des alternatives communautaires. La force RTX Video Super Resolution est sa rapidité d’execution pour l’Upscaling, toutefois il est possible de le remplacer par d’autres modèles d’Upscaling.

- macOS : En l’absence de support matériel pour les cartes RTX et les SDK propriétaires, ce workflow n’est pas supporté.

3. Tutoriel : Configurer et optimiser votre workflow ComfyUI

Passer de la théorie à la pratique demande une rigueur d’installation particulière pour que les différents modules de NVIDIA communiquent sans erreur.

3.1 Installation des nœuds essentiels et connexion Blender

Le cœur de ce flux de travail est l’extension Blender ComfyUI Blender AI Node, qui permet d’envoyer les données de profondeur directement de votre viewport (Blender) vers le pipeline de génération (ComfyUI intégré dans Blender).

- Modèles LTX-2.3 : Vous devez charger les poids du modèle ainsi que l’encodeur texte Gemma pour interpréter vos prompts de mouvement et d’audio.

- Intégration NVFX : L’installation du pack ComfyUI_NVIDIA_RTX_Nodes via le ComfyUI Manager est indispensable pour accéder au nœud propriétaire RTX Video Super Resolution.

- Liaison 3D : Dans Blender, le bouton « Launch/Connect to ComfyUI » initialise l’environnement en 30 à 60 secondes, créant un pont de données invisible pour vos cartes de profondeur.

3.2 Optimisation du rendu avec RTX Video Super Resolution (VSR)

Le VSR est la botte secrète de NVIDIA pour contourner les limites de puissance actuelles. Plutôt que de générer nativement en 4K (ce qui saturerait n’importe quel GPU grand public), le workflow produit un clip en 720p ou 1080p, puis délègue l’agrandissement aux Tensor Cores.

- Paramétrage : Pour un passage du 720p au 4K, utilisez un Upscale Factor de 3 avec un Quality Level à Ultra pour maximiser le piqué de l’image.

- Alternative open-source : Si vous travaillez sous Linux ou sans GPU RTX récent, vous devrez remplacer ce nœud par des modèles comme ESRGAN ou Lanczos. Bien que performants, ils sont souvent plus lents. Pour comparer les options, n’hésitez pas à consulter notre test du RTX VSR dans ComfyUI. Des alternatives comme SeedVR2 ou Topaz sont également pertinentes, leur objectif est différent, ils ajoutent des détails lors du redimensionnement au prix d’un temps d’execution bien supérieur.

3.3 Gestion du Multi-GPU et des ressources réseau

La génération vidéo est, par nature, extrêmement gourmande. Si votre configuration le permet, le support multi-GPU de ComfyUI permet de paralléliser certaines tâches.

- Répartition de charge : Vous pouvez dédier un GPU au rendu de la carte de profondeur dans Blender pendant que l’autre traite l’inférence LTX-2.3 dans ComfyUI.

- Vitesse d’itération : Cette approche réduit drastiquement le temps d’attente entre deux versions de votre clip, un point crucial vu la complexité du pipeline.

4. Limites réelles et debug : Éviter les pièges du pipeline (2026)

Malgré l’étiquette « haute résolution » mise en avant par NVIDIA, ce blueprint reste un assemblage complexe de technologies de pointe encore instables. Pour un créateur, la réussite d’un rendu tient souvent à la résolution de bugs spécifiques liés à la nature même de la diffusion vidéo.

4.1 La dérive du « Last Frame » et l’instabilité temporelle

L’un des plus grands défis de LTX-2.3 est de maintenir la fidélité au sujet sur toute la durée du clip. Plus la séquence est longue, plus l’IA a tendance à « oublier » l’apparence initiale du personnage ou du décor.

- Le saut visuel final : Il est fréquent que le dernier frame généré ne corresponde pas exactement à l’image clé fournie.

- La correction d’index : Pour pallier ce défaut, il est recommandé de fixer le last-frame position index à -12 (au lieu de -1) dans le nœud de guidage. Cela laisse une marge de manœuvre au modèle pour converger vers votre image cible sans saccade.

- Durée optimale : Pour conserver une cohérence acceptable, limitez vos séquences à environ 5 secondes (121 frames) dans un permier temps.

4.2 Le syndrome de la « vidéo noire »

Rien n’est plus frustrant que d’attendre la fin d’un rendu pour n’obtenir qu’un fichier noir. Ce problème n’est généralement pas un bug matériel, mais une erreur de configuration mathématique.

- La règle d’or (N×8)+1 : LTX-2.3 impose un nombre de frames très précis (ex: 65, 97, 121). Toute autre valeur peut corrompre le processus de génération.

- Placement des Crop Guides : L’oubli ou le mauvais placement des nœuds LTXVCropGuides avant l’étape VAE Decode empêche le décodage correct des images.

- Encodage texte : Assurez-vous que l’encodeur de texte Gemma est correctement lié ; sans lui, le modèle est incapable d’interpréter le mouvement et l’audio décrit dans votre prompt.

4.3 Un pipeline expérimental, pas encore un « standard studio »

Il faut rester lucide : ce workflow est une vitrine technologique plus qu’un outil de production clé en main.

- Charge cognitive : La nécessité de jongler entre Blender, les environnements Conda, et des graphs ComfyUI denses réserve ce procédé aux profils techniques.

- Dépendance matérielle : Bien que le pipeline soit brillant sur le papier, son optimisation maximale via le format NVFP4 et RTX Video Super Resolution verrouille l’utilisateur dans l’écosystème NVIDIA et l’univers Windows 11.

5. FAQ SEO : Tout savoir sur la vidéo IA RTX

Quelle différence entre Stable Video Diffusion (SVD) et LTX-2.3 ?

SVD est un modèle pionnier efficace pour des mouvements courts, mais LTX-2.3 offre une résolution native supérieure et une meilleure compréhension des prompts en langage naturel grâce à l’encodeur Gemma. De plus, LTX-2.3 est spécifiquement optimisé pour le workflow First/Last Frame, permettant de boucler ou de diriger une animation entre deux points précis avec plus de fidélité que SVD.

Peut-on faire tourner ce workflow sur un laptop RTX ?

Oui, à condition que le GPU dispose d’au moins 12 Go de VRAM (comme une RTX 4080/5080 Laptop). Cependant, la chauffe thermique et la limitation de la RAM système (souvent 16 ou 32 Go sur portable) peuvent ralentir considérablement le rendu par rapport à une tour équipée de 64 Go de RAM.

Pourquoi privilégier FLUX.1 Depth plutôt que ControlNet ?

FLUX.1 Depth est nativement entraîné pour comprendre la géométrie spatiale complexe. Contrairement à un ControlNet classique ajouté sur un modèle SDXL, FLUX.1 Depth bénéficie d’une meilleure intégration dans les workflows 3D et d’une accélération via NVFP4 sur les architectures Blackwell. Dans certains cas, cela peut offrir un meilleur compromis entre qualité, cohérence spatiale et vitesse, mais ControlNet reste pertinent pour des pipelines plus légers ou flexibles selon le projet.

Le workflow est-il compatible avec les cartes AMD ou Mac ?

Non. Ce pipeline repose sur des briques propriétaires : le format NVFP4 pour l’inférence Blackwell et le SDK RTX Video Super Resolution pour l’upscale 4K. Bien que ComfyUI soit open-source, ce blueprint spécifique est verrouillé sur l’écosystème matériel et logiciel de NVIDIA.

Conclusion : L’avenir de la création hybride

Le blueprint « RTX AI Video Generation » ne se limite pas à une évolution technique ; il marque un changement de paradigme. En déplaçant le centre de gravité de la génération vers le contrôle par la 3D, NVIDIA apporte une réponse concrète à l’un des principaux défauts des workflows actuels : le manque de maîtrise. Là où les approches Text-to-Video ou Image-to-Video reposent encore largement sur l’interprétation du modèle, l’intégration d’un environnement comme Blender permet enfin d’imposer une structure, une caméra et une intention visuelle cohérente.

L’intégration de LTX-2.3 et des optimisations comme le NVFP4 montre que la génération vidéo IA locale entre dans une phase plus mature. On ne parle plus seulement de démonstrations techniques, mais d’un pipeline capable de produire des séquences exploitables, à condition d’accepter ses contraintes actuelles.

Car ces contraintes restent bien réelles. Entre les exigences matérielles élevées, la dépendance partielle à l’écosystème Windows / RTX pour certaines briques comme le VSR, et la complexité de ComfyUI et Blender, ce workflow demeure réservé à des profils techniques. De plus, la stabilité, la durée des séquences et le temps de calcul restent des facteurs limitants selon les configurations.

Malgré cela, la direction est claire : la convergence entre 3D et modèles de diffusion ouvre la voie à une nouvelle génération d’outils hybrides. Pour les créateurs capables de maîtriser ce pipeline, il devient possible de produire des séquences visuellement ambitieuses avec un niveau de contrôle inédit, directement en local. Pour des informations plus techniques et détaillées, je vous invite à consulter cet article : Local AI Video on RTX: Mastering the NVIDIA 3D-to-Diffusion Workflow.

Avis

Ce blueprint constitue une excellente base de travail pour les créateurs avancés, en particulier pour ceux qui peinent à obtenir des résultats cohérents avec des workflows Image-to-Video ou des approches basées sur ControlNet. L’intégration d’une scène 3D comme point de départ apporte un niveau de contrôle nettement supérieur sur la composition, la caméra et la cohérence visuelle.

Si vous utilisez régulièrement ComfyUI, vous avez probablement déjà constaté les limites des workflows actuels : malgré l’usage d’images de référence ou de ControlNet, le contrôle précis des mouvements, de la caméra ou de la profondeur reste difficile et souvent imprévisible. Le problème n’est pas seulement technique, il est structurel : ces workflows manquent d’un véritable espace de contrôle spatial.

Pour diriger efficacement une génération vidéo, il faut disposer d’informations spatiales fiables en amont. C’est précisément ce que permet un environnement 3D comme Blender, qui devient ici un véritable outil de mise en scène. Ce workflow propose ainsi une approche hybride pertinente, entre rendu 3D traditionnel et génération vidéo par IA.

Il faut toutefois garder du recul : NVIDIA met logiquement en avant son écosystème matériel et ses technologies propriétaires. Mais l’essentiel est ailleurs. Le véritable apport de ce blueprint réside dans son architecture, qui peut être adaptée avec des modèles, nœuds et outils plus ouverts selon votre environnement.

En ce sens, ce blueprint n’est pas seulement une vitrine technologique, mais une direction claire pour l’évolution des pipelines de génération vidéo IA.

Ressources utiles

- Article de Nvidia sur le Blueprint NVIDIA Video Generation Guide

- Nvidia 3D Object Generation Blueprint

- Nvidia 3D Guided Generative AI Blueprint

- Nvidia Workflow ComfyUI LTX 2.3 avec RTX Video Super Resolution

- Blender

Pour ne rien rater, abonnez-vous à Cosmo Games sur Google News et suivez-nous sur X (ex Twitter) en particulier pour les bons plans en direct. Vos commentaires enrichissent nos articles, alors n'hésitez pas à réagir ! Un partage sur les réseaux nous aide énormément. Merci pour votre soutien !