Lancement de Sora d’OpenAI en 2024 – IA générateur de vidéo

Le lancement de Sora, l’IA génératrice de vidéos à partir de texte développé par OpenAI, se fera cette année.

Le mois dernier, OpenAI, la société à l’origine de ChatGPT, a une fois de plus surpris le monde en dévoilant son dernier modèle d’IA : Sora, un générateur de vidéos à partir de texte. Une démonstration de la société a montré la capacité de Sora à produire des vidéos et des simulations d’objets en mouvement, comme une femme marchant à Tokyo, à partir de simples instructions textuelles, avec une précision quasiment parfaite.

Cependant, OpenAI a choisi de ne pas le rendre immédiatement disponible, invoquant le besoin de ses chercheurs de déterminer les éventuels risques liés à cette technologie. Néanmoins, il est désormais clair que la sortie publique d’un tel outil, que ce soit de la part d’OpenAI ou de ses concurrents, est imminente. Mira Murati, CTO de OpenAI, a confirmé que Sora sera accessible cette année.

Quelle est la date de lancement de Sora d’OpenAI ?

Pour le moment, aucune date de lancement de Sora n’a été annoncée officiellement, OpenAI est resté vague. Cependant vu les risques de Deepfakes sur les élections américaines, il fort probable qu’OpenAI évite de publier son générateur de vidéo avant la fin des élections, le 5 novembre.

Comme nous l’avons indiqué précédent, il est de plus en plus difficile d’identifier le contenu généré par IA. Un outil comme Sora pourrait avoir un impact négatif sur les élections et OpenAI n’a pas besoin de ce genre de publicité. Surtout que lors du lancement, les IA ont besoin d’ajustement pour éviter les utilisations frauduleuses.

Officiellement, Murati a confirmé que Sora serait disponible dans les prochains mois, mais a évité de donner une période plus précise.

Quel contenu a été utilisé pour entrainer Sora ?

Lors d’une interview accordée au Wall Street Journal, Murati a été évasive lorsqu’elle a été interrogée sur les données utilisées pour entraîner ce modèle d’IA.

Murati a précisé que les données utilisées pour former Sora étaient soit accessibles au public, soit fournies par des partenaires tels que Shutterstock. Elle a exprimé des incertitudes quant à l’utilisation de vidéos provenant des médias sociaux et a souligné qu’elle ne souhaitait pas entrer dans les détails à ce sujet.

Quel sera le coût d’utilisation de Sora ?

La CTO d’OpenAI a confirmé que l’utilisation de Sora est actuellement très coûteuse, mais que la société cherche à optimiser les coûts pour le proposer à un prix similaire à celui du modèle texte-vers-image DALL·E lors de son lancement officiel.

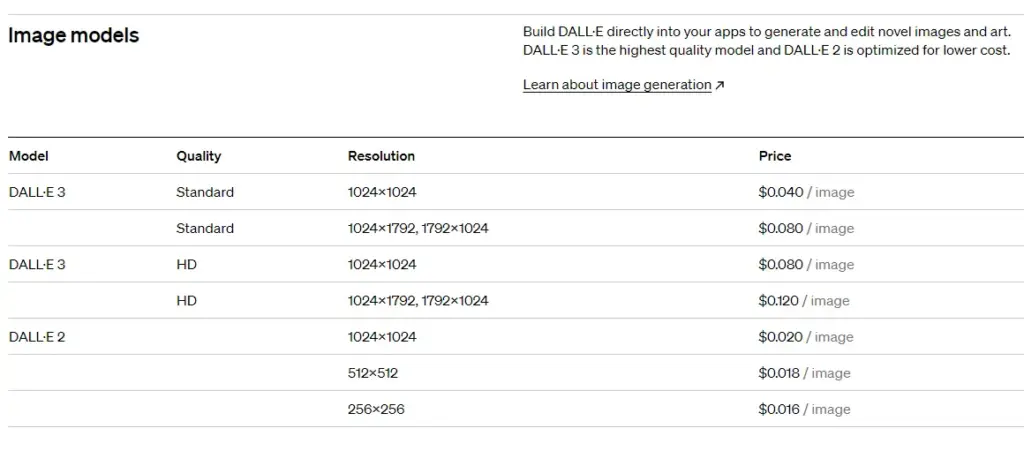

Le coût de génération d’une image standard dans DALL·E 3 démarre à 0,04 $, tandis qu’une image en haute définition commence à 0,08 $.

En partant du coût de génération d’une image HD de DALL-E, il est difficile de faire une estimation du coût de génération d’une vidéo d’une minute avec Sora. Pour une vidéo HD à 24 images par seconde, il faudra donc 1440 images (24 img/s x 60 minutes). Néanmoins il ne s’agit pas de 1440 nouvelles images, il y a une logique temporelle qu’OpenAI exploite. Un coût à la minute entre 4$ et 5$ parait réaliste, mais il faudra attendre les déclarations officielles pour avoir une vision plus claire.

Aujourd’hui DALL-E est intégré dans l’abonnement ChatGPT Plus. Dans le cas de Sora, l’intégration dans l’abonnement ChatGPT Plus parait nettement plus difficile, notamment à cause des coûts de génération associés.

Murati a également indiqué qu’OpenAI envisage d’ajouter davantage de fonctionnalités à Sora, notamment l’intégration de l’audio et d’autres capacités de montage vidéo. Cependant, aucune démonstration de ces fonctionnalités n’a encore été présentée. Il reste à voir quelles autres caractéristiques Sora offrira lors de son lancement officiel, mais nous devrions le découvrir dans les prochains mois.

Pour ne rien rater, abonnez-vous à Cosmo Games sur Google News et suivez-nous sur X (ex Twitter) en particulier pour les bons plans en direct. Vos commentaires enrichissent nos articles, alors n'hésitez pas à réagir ! Un partage sur les réseaux nous aide énormément. Merci pour votre soutien !