Discord et l’IA locale : sécurité ultime ou boîte noire technique ?

Dès mars 2026, Discord bascule dans une nouvelle ère de régulation. Sous la pression du UK Online Safety Act et des autorités australiennes, la plateforme impose une vérification d’âge. Mais derrière l’écran noir qui frappera les comptes non vérifiés se cache un défi technique colossal : l’exécution d’une IA de reconnaissance faciale en local (Edge AI) sur des millions d’appareils hétérogènes.

Mise à jour 25 février 2026

Discord a finalement repoussé le déploiement mondial de la vérification d’âge à la seconde moitié de 2026 après de nombreuses critiques liées à la confidentialité. Les analyses techniques publiées précédemment restent valables, mais le calendrier et la communication de Discord ont évolué.

Nous avons décortiqué les entrailles de cette technologie. Est-ce le futur de la vie privée ou un nouveau goulot d’étranglement pour les utilisateurs ? Pour en savoir plus, consultez notre dossier spécial sur la vérification d’âge Discord.

L’IA on-device : la prouesse technique sous le capot

Plutôt que d’envoyer votre visage sur ses serveurs, un risque juridique et sécuritaire majeur après le piratage du prestataire 5CA en octobre 2025 (ayant fuité 70 000 pièces d’identité), Discord déporte l’intelligence sur votre machine. Ce choix du « Local-first » répond directement aux exigences de la CNIL et du RGPD sur la minimisation des données.

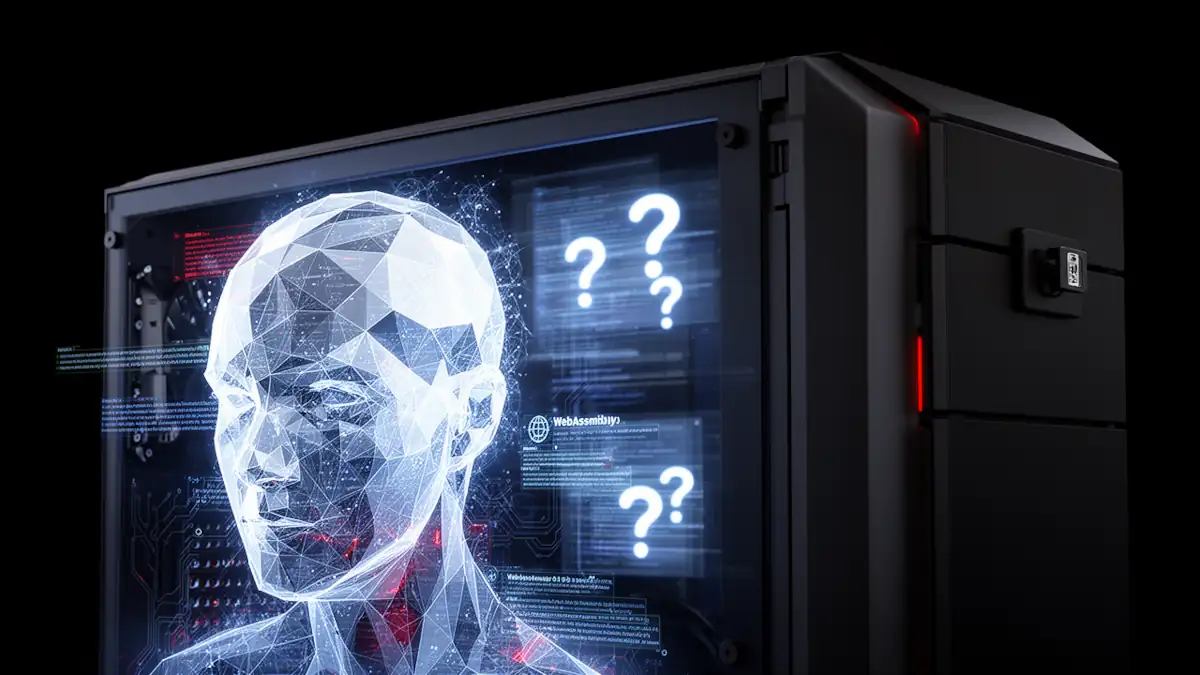

Architecture WebAssembly et modèles CNN

Discord utilise WebAssembly (WASM) pour exécuter du code haute performance dans son client Electron ou sur navigateur.

- Le Modèle : Bien que Discord ne nomme pas officiellement son partenaire de « face scan », l’architecture employée pointe vers un réseau de neurones convolutifs (CNN) léger. Ce type de modèle, standardisé par des acteurs comme Yoti ou disponible en Open Source sur Hugging Face, est optimisé pour l’inférence locale.

- Liveness Detection (PoC) : Pour éviter d’être dupée par une simple photo, l’IA utilise les landmarks faciaux pour exiger des mouvements en temps réel. Une faille technique célèbre lors des tests au Royaume-Uni a illustré les limites de ces algorithmes : des utilisateurs ont réussi à tromper le système en utilisant le mode photo ultra-réaliste de Death Stranding. En manipulant les expressions faciales du personnage Sam Porter, ils ont validé la « preuve de vie » exigée par l’outil, forçant Discord à affiner ses filtres de texture de peau.

Performances estimées selon votre setup

| Hardware | Temps d’inférence | Impact CPU |

|---|---|---|

| PC Gamer (GPU RTX/GTX) | < 1s | Imperceptible |

| PC Bureau (Intel i5/Ryzen 5) | 2 – 4s | Pic de charge bref |

| Smartphone entrée de gamme | 5 – 10s | Chauffe légère |

| Laptop ancien (< 2018) | 8 – 12s | Ralentissement possible |

Le revers de la médaille : fiabilité et « Boîte Noire »

Si la promesse de confidentialité est séduisante, la réalité technique soulève des questions de fiabilité et d’éthique algorithmique.

Le défi de la MAE (Mean Absolute Error)

Selon les standards du NIST (FATE), les modèles d’estimation d’âge présentent une erreur moyenne (MAE) de 2 à 4 ans.

Le chiffre critique : Les tests pilotes ont montré un taux de faux négatifs (adultes classés mineurs) de 10 % à 28 % chez les 18-22 ans. Un éclairage médiocre ou le port de lunettes peut déclencher un échec de l’IA, forçant l’utilisateur à se rabattre sur l’envoi d’une pièce d’identité via Persona, un processus nettement plus intrusif.

L’opacité des audits : un paradoxe stratégique

C’est ici que le bât blesse. Alors que des solutions du marché comme Yoti jouent la carte de la transparence avec des audits publics (NIST, ACCS), le système intégré par Discord reste une propriété close. Bien que conforme au RGPD sur le papier, aucun audit indépendant public n’a encore validé l’étanchéité totale du code exécuté on-device. Pour les experts, cela reste une « boîte noire » dont il faut croire les promesses sur parole, créant un contraste saisissant entre la sécurité affichée du selfie et l’opacité du code.

Pourquoi les créateurs indépendants sont-ils laissés pour compte ?

Chez Cosmo-games, nous prônons l’IA locale comme outil de personnalisation et de respect de la vie privée. Pour les éditeurs indépendants, reproduire la stratégie de Discord est aujourd’hui envisageable en intégrant des SDK tiers spécialisés. Ces outils permettent d’exécuter des modèles complexes directement dans le navigateur via WebAssembly, garantissant que l’analyse reste confinée à la mémoire vive de l’utilisateur.

L’IA locale, sauveuse de la vie privée ou privilège de géant ?

Le passage de Discord à l’IA on-device marque un tournant décisif où le cloud n’est plus la solution par défaut pour le traitement des données sensibles. En s’appuyant sur l’Edge AI, la plateforme tente de réconcilier les exigences réglementaires avec le droit à l’anonymat relatif.

Cependant, cette transition vers l’IA locale suffira-t-elle à restaurer une confiance durable ? Le paradoxe est de taille : Discord sécurise l’accès d’un côté via un scan facial anonymisé, mais continue de l’autre d’affiner ses modèles d’inférence comportementale basés sur vos métadonnées privées. L’enjeu de 2026 sera de voir si cette approche « Privacy by Design » deviendra un standard audité pour tous, ou s’il restera un simple bouclier marketing pour les géants du Web.

A lire également : La fin de l’anonymat par défaut sur Discord : quel impact pour les communautés 18+ ?

Pour ne rien rater, abonnez-vous à Cosmo Games sur Google News et suivez-nous sur X (ex Twitter) en particulier pour les bons plans en direct. Vos commentaires enrichissent nos articles, alors n'hésitez pas à réagir ! Un partage sur les réseaux nous aide énormément. Merci pour votre soutien !