RTX Video Super Resolution dans ComfyUI : L’upscaling neuronal en temps réel au service du flux créatif

Le défi de la mise à l’échelle dans les workflows d’intelligence artificielle a longtemps reposé sur un compromis frustrant entre la vitesse d’exécution et la fidélité visuelle. Traditionnellement, l’utilisateur de ComfyUI devait arbitrer entre des modèles de diffusion gourmands en ressources et des algorithmes de post-traitement parfois destructeurs. L’arrivée du nœud officiel NVIDIA RTX Video Super Resolution (VSR) pour ComfyUI marque un tournant stratégique : l’intégration d’un pipeline de traitement vidéo professionnel directement au sein du canevas génératif.

Plutôt que d’être un simple filtre post-process, le RTX VSR s’impose comme un composant neuronal dédié, capable de transformer la productivité des créateurs. En exploitant la puissance des architectures modernes, ce nœud permet de s’affranchir des lenteurs habituelles de l’upscaling pour se concentrer sur la qualité de la production finale. Pour en comprendre les fondements, il est utile de se référer à l’évolution des technologies de mise à l’échelle comme le Nvidia DLSS : fonctionnement et historique.

1. Comprendre l’upscaling dans l’écosystème ComfyUI

Dans l’architecture nodale de ComfyUI, l’augmentation de résolution se divise généralement en deux catégories distinctes. D’un côté, le Latent Upscale intervient avant le décodage VAE ; il est intrinsèquement créatif car il demande au modèle de « réimaginer » l’image à une échelle supérieure, ce qui peut entraîner des dérives anatomiques ou stylistiques. De l’autre, le Model Upscale (ou Pixel Upscale) agit sur l’image décodée en utilisant des réseaux de neurones spécialisés comme SwinIR ou la famille ESRGAN.

C’est ici que les limites des méthodes traditionnelles apparaissent, particulièrement lors du traitement de vidéos ou de flux à haute cadence. Les modèles conventionnels ont souvent été entraînés sur des images statiques et peuvent peiner à maintenir une cohérence de texture ou à traiter les artefacts de compression sans introduire un lissage excessif. Le besoin d’une solution capable de traiter le signal avec une rigueur « vidéo » tout en restant performante a conduit à l’adoption du VSR. Pour approfondir ces distinctions, consultez notre guide sur le Latent upscale vs model upscale dans ComfyUI.

2. Comment fonctionne réellement RTX Video Super Resolution ?

Contrairement à une idée reçue, le RTX Video Super Resolution n’est pas un simple algorithme d’interpolation de pixels piloté par le driver. Il s’agit d’un modèle d’upscaling neuronal propriétaire, spécifiquement optimisé pour être exécuté sur les Tensor Cores des GPU NVIDIA. Intégré nativement dans le pipeline vidéo, il combine l’intelligence artificielle et le traitement du signal pour accomplir trois missions critiques :

- L’Upscaling intelligent : Augmentation de la densité de pixels en préservant la clarté des bords.

- La réduction des artefacts : Élimination du « blocking » (blocs de compression) et du « ringing » (échos visuels autour des contours).

- La reconstruction de structures : Amélioration de la netteté globale sans inventer de nouveaux éléments sémantiques.

La différence fondamentale avec un modèle type ESRGAN réside dans sa philosophie : là où un modèle génératif pourrait « halluciner » des pores de peau ou des fibres de tissu inexistants, le VSR se concentre sur la restauration des structures réelles et la propreté du signal. C’est un outil de précision chirurgicale qui tire sa force du RTX Video SDK Nvidia.

3. Méthodologie du Benchmark : Le duel

Pour évaluer les performances réelles du nœud RTX Video Super Resolution (VSR), nous avons établi un protocole de test. L’objectif est de comparer l’efficacité du traitement matériel neuronal face à l’inférence logicielle classique.

- Matériel utilisé : NVIDIA RTX 5090 avec 32 Go de VRAM.

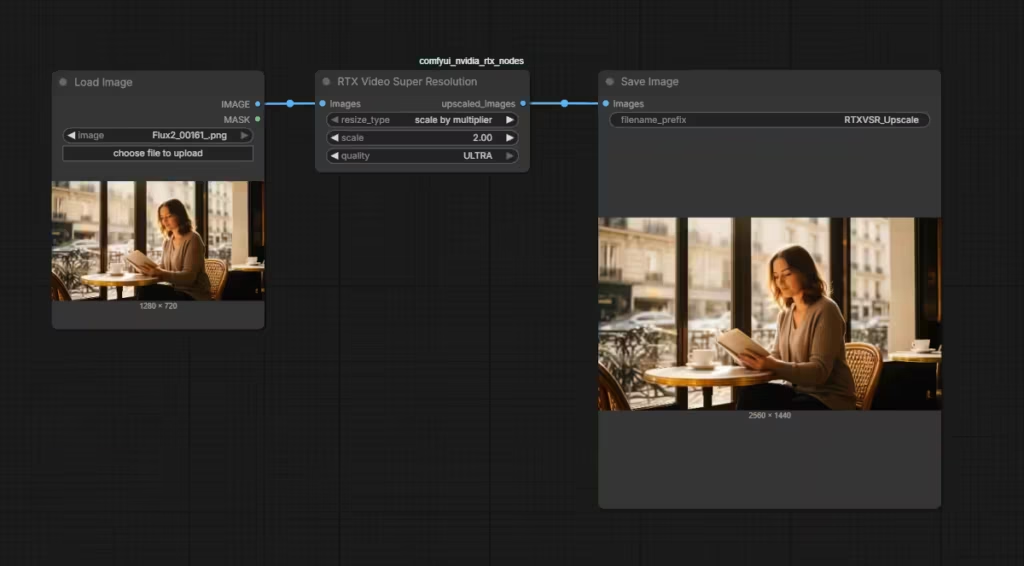

- Environnement logiciel : ComfyUI (version 2026), intégrant le nœud officiel Nvidia_RTX_Nodes_ComfyUI.

- Image de référence : Une génération photoréaliste produite avec le modèle FLUX.2 Dev FP8 en résolution native 1280×720.

- Modèle comparatif : RealESRGAN_x4plus, le standard actuel pour l’upscaling de précision dans la communauté IA.

- Paramètres de test : Mise à l’échelle x4 avec le réglage « Quality=Ultra » pour le VSR.

L’utilisation du format FP8 pour la source est ici stratégique. Ce format, bien que performant, peut introduire de légers artefacts de quantification que l’upscaler doit être capable de gérer sans les amplifier inutilement. Pour plus de détails sur l’impact des formats, consultez notre dossier : ComfyUI : format BF16, FP16, FP8 ou GGUF.

(Cliquer pour agrandir)

4. Résultats : RTX VSR vs RealESRGAN_x4plus

Les mesures effectuées sur la RTX 5090 mettent en évidence une rupture technologique majeure, tant sur le plan de la vélocité que de la fidélité structurelle.

Analyse de la performance brute

| Caractéristique | RTX Video Super Resolution (Ultra) | RealESRGAN_x4plus |

|---|---|---|

| Temps de rendu (x2) | 0,99 seconde | N/A (modèle x4 natif) |

| Temps de rendu (x4) | 1,86 seconde | 3,13 secondes |

| Consommation VRAM | Négligeable (Buffer Driver) | Chargement du modèle (~1-2 Go) |

Le nœud matériel pulvérise les records de vitesse avec un gain de productivité d’environ 40% par rapport à RealESRGAN. Cette réactivité est un atout critique pour les workflows vidéo où chaque frame compte.

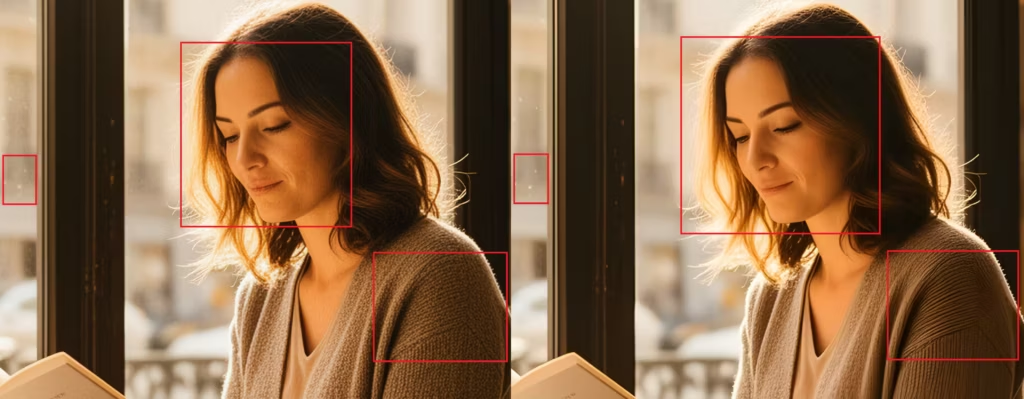

(Cliquer pour agrandir)

Analyse qualitative : Fidélité vs Interprétation

L’observation à 100% révèle deux philosophies opposées :

- RTX VSR (La reconstruction fidèle) : Le modèle se comporte comme un miroir haute définition. Il conserve l’intégralité des éléments de l’image source sans aucune dénaturation. Les textures complexes, comme le maillage d’un pull, gardent leur intégrité structurelle. Cependant, sa précision est telle qu’il peut amplifier le bruit s’il est présent dans la source.

- RealESRGAN (L’interprétation esthétique) : Ce modèle applique un lissage caractéristique. S’il élimine efficacement les traces sur une vitre ou les défauts de peau, il le fait au prix d’un aspect légèrement « plastique ». Certains détails fins sont transformés ou simplifiés par le processus de débruitage logiciel.

En somme, le VSR privilégie la vérité du signal là où RealESRGAN privilégie la propreté visuelle.

5. Analyse des cas d’usage : Quand choisir le VSR ?

Le choix entre le RTX Video Super Resolution et un modèle classique dépend moins de la résolution cible que de la nature de votre projet. Grâce à son exécution temps réel sur Tensor Cores, le VSR s’impose dans des scénarios où la fidélité et la fluidité sont non négociables.

- Workflow Vidéo et Animation (LTX-Video) : L’avantage majeur du VSR réside dans sa cohérence temporelle. Contrairement aux modèles d’upscale image par image qui peuvent générer du scintillement (flicker), le VSR traite le signal de manière stable, ce qui est idéal pour les séquences générées par IA.

- Nettoyage de générations rapides : Pour les utilisateurs exploitant des modèles quantifiés comme le FLUX.2 Dev FP8, le VSR permet de compenser efficacement les artefacts de quantification sans la lourdeur d’un second passage de diffusion.

- Production de masse : Dans un pipeline industriel où des centaines d’images doivent être traitées, le gain de temps cumulé (1,86s contre 3,13s) devient un facteur de rentabilité majeur.

Pour des besoins plus spécifiques de reconstruction créative, vous pouvez consulter notre dossier sur le HiDream-I1-Dev ComfyUI : guide latent upscaling optimal.

6. Workflow ComfyUI recommandé : Le Pipeline Hybride

Pour tirer le meilleur parti de votre GPU, nous préconisons une structure de workflow qui délègue chaque tâche à l’outil le plus performant. L’idée est d’utiliser la puissance générative de FLUX pour l’intention, et la précision du VSR pour la définition.

La structure type

- Génération (FLUX.2 Dev) : Création de l’image en basse résolution (ex: 720p ou 1080p) pour économiser du temps d’échantillonnage.

- Décodage VAE : Passage du domaine latent au domaine pixel.

- Upscale RTX VSR : Mise à l’échelle immédiate en 4K avec le paramètre Quality=Ultra.

- Optionnel – Raffinement (RealESRGAN) : Si et seulement si la source originale était trop bruitée, un léger passage via RealESRGAN peut servir de filtre de lissage final.

Conseil : Ne cherchez pas à « pousser » le débruitage dans le prompt si vous utilisez le VSR. Laissez le modèle générer une texture naturelle, le nœud NVIDIA se chargera de la redimenssionner sans la dénaturer.

7. Limites et FAQ technique

Malgré ses performances, le RTX VSR impose certaines contraintes liées à son architecture matérielle.

- L’exclusivité Hardware : Le nœud nécessite obligatoirement un GPU NVIDIA des générations Ampere (30xx), Ada Lovelace (40xx) ou Blackwell (50xx). Les Tensor Cores sont indispensables à l’exécution du modèle neuronal VSR.

- La qualité de la source : Le VSR étant un « amplificateur de vérité », il ne corrigera pas un mauvais prompt ou une image floue. Il rendra le flou plus net, mais ne le transformera pas en détail.

- Optimisation VRAM : Sur des cartes à mémoire limitée, l’utilisation du VSR est salvatrice car elle ne nécessite pas de charger des modèles d’upscale massifs en mémoire vidéo. Pour bien calibrer votre usage, lisez ComfyUI : choisir la taille de modèle adaptée à votre VRAM.

Conclusion et perspectives

L’intégration du RTX Video Super Resolution dans ComfyUI marque la fin d’une époque où l’upscale de haute qualité était nécessairement synonyme de lenteur. Pour les possesseurs de RTX 50, ce nœud transforme une tâche autrefois lourde en une simple formalité technique de moins de deux secondes (RTX 5090).

Le verdict est sans appel : si votre priorité est la productivité et la fidélité absolue, la solution matérielle de NVIDIA est imbattable. L’avenir de l’upscaling dans ComfyUI semble s’orienter vers ces flux hybrides, ouvrant la voie à une création vidéo 4K enfin fluide. Un ajout futur de technologies comme le Nvidia DLSS 4.5 pourrait encore repousser les limites de la génération de frames en temps réel.

Pour ne rien rater, abonnez-vous à Cosmo Games sur Google News et suivez-nous sur X (ex Twitter) en particulier pour les bons plans en direct. Vos commentaires enrichissent nos articles, alors n'hésitez pas à réagir ! Un partage sur les réseaux nous aide énormément. Merci pour votre soutien !